🤖 New York Times e OpenAI troveranno un accordo? - Legge Zero #6

Per il New York Times il modello di business dell’IA generativa è basato su una violazione sistematica del diritto d’autore. Il futuro dell’IA lo decideranno i giudici se non arriverà prima un accordo

Se una persona legge un articolo di giornale, poi va in un bar e ripete ciò che ha letto, nessuno la considera una violazione del diritto d’autore. Ma cosa succede quando un sistema di intelligenza artificiale legge lo stesso articolo e poi lo usa per alimentare un chatbot o uno strumento di ricerca in grado di riassumere o addirittura riprodurre il contenuto dell'articolo?

È una delle questioni che dovrà affrontare il Tribunale di New York in una causa che sembra lontanissima da noi – non solo geograficamente – ma invece potrebbe condizionare il mondo dell’IA generativa per come lo conosciamo oggi. Nei giorni tradizionalmente dedicati alle vacanze natalizie la New York Times Company ha portato davanti alla Corte federale di New York Microsoft e OpenAI sostenendo che queste aziende hanno utilizzato illegalmente milioni di articoli del Times protetti da copyright per aiutare a sviluppare i modelli di intelligenza artificiale che stanno dietro strumenti come ChatGPT e Bing. È l'ultima, in ordine di tempo, e secondo alcuni la più solida tra le serie azioni legali avviate negli ultimi mesi contro le società che gestiscono sistemi di IA per violazione dei diritti di proprietà intellettuale di società, siti di fotografia, autori e artisti (ne abbiamo parlato nell’ultimo numero del 2023 di LeggeZero).

Per deformazione professionale, ho letto l’atto introduttivo: 69 pagine, davvero ben scritte e molto suggestive, cioè pensate per convincere una giuria, spiegando molto bene le questioni alla base della controversia. Si tratta di un elemento fondamentale per un contenzioso in materie così innovative: farsi capire da chi deve giudicare. Nell’atto degli studi legali Susman Godfrey e Rotwell, Figg, Ernst & Manbek il ragionamento è chiaro:

- il New York Times è un punto di riferimento mondiale per il giornalismo indipendente;

- il giornalismo indipendente costa (tanto);

- la New York Times Company ha strutturato un modello di business remunerativo basato su abbonamenti (oltre 10 milioni), pubblicità, licenze sui contenuti, programmi di affiliazione;

- la New York Times Company non ha mai concesso licenza a Microsoft e OpenAI per addestrare sui propri contenuti i modelli che stanno dietro Bing e ChatGPT;

- Bing e ChatGPT mettono gravemente a rischio il modello di business dell’editore e generano danni per miliardi di dollari, compromettendo la possibilità di continuare a fare il giornalismo che ha reso il NYT un punto di riferimento per tutti.

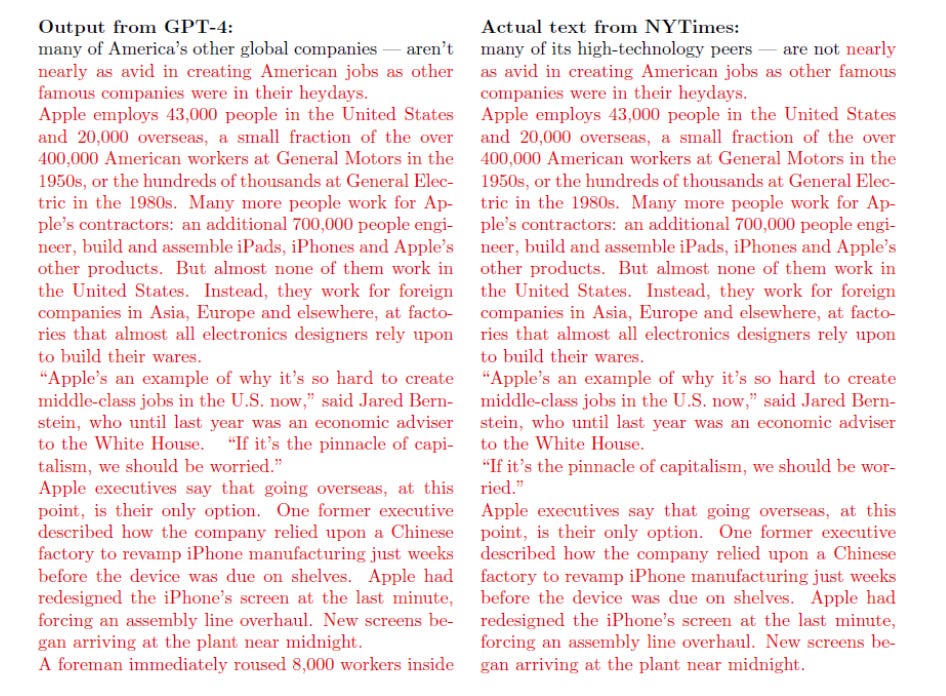

Questi passaggi sono accompagnati da un’illustrazione molto chiara dei meccanismi di funzionamento dell’IA generativa (specialmente del suo addestramento) e del modo in cui le società che gestiscono questi sistemi lucrano, penalizzando l’editore. Molto efficace, ad esempio, il passaggio in cui – a sostegno delle proprie tesi – gli avvocati del NYT mettono a confronto l’output di ChatGPT e gli articoli originali. In alcuni casi (ovviamente accuratamente scelti) praticamente sovrapponibili.

Molto suggestive anche le contestazioni relative alle allucinazioni di ChatGPT, capaci di produrre articoli mai effettivamente scritti (con tanto di link inventati) in grado di alimentare la disinformazione e produrre un danno d’immagine per il NYT.

Se volete approfondire i contenuti del documento, oltre alle sintesi giornalistiche, vi segnalo gli ottimi contributi del prof. Giovanni Ziccardi (che su Youtube ha letto tutto l’atto) e del collega Bruno Saetta (che su ValigiaBlu ha messo a fuoco le principali questioni). Io stesso ne ho parlato con Alessio Jacona in un podcast di Ansa che potete riascoltare qui.

Sicuramente ne riparleremo, anche alla luce delle difese di Microsoft e OpenAI. Per quello che sappiamo, sosterranno il fair use, cioè la possibilità secondo le leggi USA di poter liberamente utilizzare quei contenuti anche senza autorizzazione da parte del NYT (qui sono citati alcuni precedenti a cui probabilmente si richiameranno le difese delle due società).

Fin qui i fatti o, meglio, gli atti. Ma perché questa causa è così importante anche per noi? Per diverse ragioni. Innanzitutto, indipendentemente dall’eventuale risarcimento monetario che dovesse essere riconosciuto al NYT, se l’azione legale venisse accolta, non solo risulterebbero inutilizzabili i modelli alla base delle IA generative (perché addestrati in modo non lecito), ma le attività di addestramento diventerebbero più onerose (passando per un accordo necessario con tutti i detentori dei diritti) e quindi alla portata di pochissimi soggetti, con ricadute ovvie sia sull’affidabilità delle soluzioni sia sul costo di queste ultime per gli utenti.

Inoltre, trattandosi di un’azione promossa nel Paese dove operano tutti i principali operatori del settore, l’esito di quest’azione legale avrà comunque effetti per gli utenti di tutto il mondo. Nel frattempo, il Giappone - per dare uno stimolo al settore dell’IA - si starebbe orientando nel senso di concedere alle aziende l’uso di materiali protetti dal copyright anche senza necessità di autorizzazione. In Europa, invece, l’accordo raggiunto su AI Act prevede obblighi di trasparenza, richiedendo agli operatori del settore di rivelare nel dettaglio quali materiali protetti da copyright sono stati utilizzati per l’addestramento del sistema. Questo dovrebbe consentire ai detentori dei diritti di poter esercitare l’opt-out chiedendo che i propri contenuti non vengano più considerati dall’IA. Ma entrambe le disposizioni sembrano di difficile applicazione in concreto e potrebbero generare incertezza e contenzioso.

Per questo motivo è opportuno che aziende e amministrazioni inizino a ragionare fin da ora, anche in Italia, su soluzioni giuridiche (l’aggiornamento dei termini di licenza dei propri siti e prodotti) e tecnologiche (misure per impedire che i contenuti dei propri siti possano essere usati nell’addestramento dell’IA).

Anche perché l’ultimo scenario che dobbiamo prendere in considerazione è che in questo contenzioso la sentenza non arriverà mai, perché magari le parti raggiungeranno un accordo. Del resto, OpenAI ha già stipulato accordi in virtù dei quali The Associated Press e Axel Springer hanno fornito apposita licenza per l’utilizzo dei propri contenuti. L’ipotesi della transazione, però, è la meno interessante, anche giuridicamente. Sia perché l’accordo varrebbe solo tra le parti sia perché consoliderebbe una sperequazione tra chi – come il NYT – ha la forza per costringere gli attori dell’IA a fare un accordo e i tanti autori o piccoli editori che quella forza non hanno e non avranno mai.

🔊 Un vocale da… Antonio Palmieri (Fondazione Pensiero solido): celebriamo i 20 anni della legge italiana in materia di accessibilità (Legge 9 gennaio 2004 n. 4) con il messaggio di uno dei suoi promotori che ci spiega come l’IA possa essere utilizzata per assicurare i diritti delle persone con disabilità.

🔊 Un vocale da… Massimo Chiriatti (Lenovo): iniziamo l’anno con il messaggio di uno dei massimi esperti italiani di IA che ci illustra le sfide che abbiamo davanti, approfondendo il tema delle competenze. Come possiamo farci trovare pronti?

📰 Da Stanford un’app che rivoluziona la geolocalizzazione di immagini

Mantenere le nostre informazioni personali al sicuro su Internet diventa sempre più difficile . Una nuova intelligenza artificiale sviluppata dai ricercatori di Stanford chiamata Predicting Image Geolocations (PIGEON) fa esattamente quello che dice il nome.

Il tasso di successo è del 92% nel riconoscimento del Paese e di oltre il 40% nell'individuazione della località in un raggio di 25 km dalla posizione esatta in cui è stata scattata la foto.

Sebbene questa tecnologia possa avere casi d’uso utili (come trovare luoghi in cui sono state scattate foto storiche), la capacità dell’intelligenza artificiale di individuare la posizione con una precisione così elevata mette a rischio la sicurezza personale di molti. Bisognerà fare ancora più cautela nel condividere foto, specialmente sui social. Estote parati!

📰 L’ex avvocato di Trump deposita precedenti inesistenti (creati dall’IA)

Michael Cohen, ex avvocato di Donald Trump radiato nel 2019 dall’albo, ha inviato al proprio avvocato alcuni precedenti giurisprudenziali frutto di allucinazioni di Google Bard. L’avvocato non ha verificato che quei precedenti esistessero davvero e quindi li ha depositati in un giudizio in corso dinanzi al Tribunale di New York.

Di chi è la colpa? Evidentemente sono sempre più urgenti le regole che obblighino gli avvocati a una verifica scrupolosa di tutti i materiali prodotti in giudizio (ne abbiamo parlato qui).

⚖️ Linee Guida FBE per l'uso responsabile dell'IA da parte degli avvocati

Nel contesto in cui viviamo e vista la velocità delle nuove tecnologie, in attesa di nuove regole (deontologiche e processuali) ha senso diffondere il più possibile le raccomandazioni che esistono già.

Qualche tempo fa l'Associazione degli Ordini europei degli avvocati (FBE) ha rilasciato delle linee guida per l'uso dell'intelligenza artificiale generativa e dei modelli linguistici di grandi dimensioni nella professione legale.

Le raccomandazioni enfatizzano la necessità di comprendere la tecnologia, riconoscere le sue limitazioni, rispettare le regole deontologiche esistenti, integrare le competenze legali, assicurare il segreto professionale, proteggere i dati personali, e informare i clienti assumendosi la responsabilità.

Il documento è stato tradotto in italiano ed è disponibile qui.

😂 IA Meme

Qualcuno ha usato l’IA per animare uno dei meme più famosi di sempre, quello del fidanzato distratto.

📚 Consigli di lettura: “Il visconte cibernetico”

Nulla ci vieta di prevedere una macchina letteraria che a un certo punto senta l’insoddisfazione del proprio tradizionalismo e si metta a proporre nuovi modi di intendere la scrittura e a sconvolgere completamente i propri codici.

Questo passaggio di “Cibernetica e fantasmi” (opera del 1967) è tra i tanti riportati nel libro "Il Visconte Cibernetico. Italo Calvino e il sogno dell'intelligenza artificiale" di Andrea Prencipe e Massimo Sideri.

Si tratta di un testo breve, consigliabile per chi conosce bene l’opera dell’autore del “Visconte dimezzato” e vuole riflettere su come le idee di Calvino possano aiutarci a navigare in questo contesto che evolve tanto velocemente.

📣 Eventi

La legge Stanca vent’anni dopo - Roma, 9.1.2024

ComunicherAI - Tra intelligenza artificiale e artigianale: l’evoluzione del modo di fare impresa - Roma, 16.1.2024

AI Festival - Milano, 14-15 .2.2024

Per questa settimana è tutto, torniamo sabato prossimo. Se la newsletter ti è piaciuta, commenta o fai girare. Grazie!