🤖 Legge Zero #4 - Questa newsletter non è stata scritta da un'IA

È sempre più difficile riconoscere i contenuti generati da IA da quelli creati dagli esseri umani. Dagli USA arriva la proposta di obbligare gli avvocati a dichiarare ogni eventuale aiuto artificiale.

🧠 Moriremo di disclaimer?

Facciamo un test. Guardate l’immagine qui sopra e provate a distinguere quali volti corrispondono a persone reali e quali sono generati dall’intelligenza artificiale. Credete di essere in grado di distinguerli? Una recente ricerca condotta da esperti dell’Australian National University dice che probabilmente vi sbagliate. Lo studio dimostra che i volti generati dall'intelligenza artificiale (AI) appaiono più reali dei volti umani.

Ma non si tratta di un fenomeno che riguarda solo le immagini generate da IA. Come abbiamo riportato nel #3 di LeggeZero, il Consiglio comunale di Porto Alegre ha approvato all’unanimità un regolamento che nessuno - tranne il consigliere proponente - sapeva essere stato generato interamente mediante ChatGPT.

Non solo norme, ma anche atti giudiziari possono essere creati dall’IA in modo talmente verosimile che anche un (disattento?) operatore professionale può essere tratto in inganno. È il caso dell’avvocato newyorkese che è stato sanzionato per aver citato precedenti inesistenti e generati da una delle più celebri allucinazioni di ChatGPT (gli ormai famosi casi Martinez contro Delta o Varghese contro China Southern Airlines).

Non possiamo escludere che anche in Italia esistano già provvedimenti amministrativi (come delibere comunali) o atti giudiziari (ricorsi o sentenze, ad esempio) generati attraverso IA e che citano leggi o regolamenti inesistenti. E se non è ancora accaduto, potrebbe accadere presto, generando contenziosi e contestazioni per gli avventati utilizzatori (e le organizzazioni per cui lavorano).

Una soluzione immediatamente praticabile può essere quella di imporre la massima trasparenza nella presentazione di immagini, video o testi in modo da consentire a tutti di capire se il contenuto è stato generato attraverso il ricorso a sistemi di intelligenza artificiale. In questa direzione vanno l’AI Act e anche alcune proposte presentate nel nostro Parlamento.

Ma, in attesa che arrivino leggi, anche tecnologicamente evolute, come possiamo fare per essere sicuri che quello che stiamo leggendo non è stato generato da un’IA? Sotto questo profilo è interessante la proposta che arriva dalla Corte di appello di New Orleans (USA) relativa all’introduzione di nuove regole sull'uso dell'intelligenza artificiale nel deposito di atti giudiziari. Se tale proposta sarà recepita, gli avvocati dovranno dichiarare sotto la propria responsabilità – e quindi a pena di sanzioni disciplinari - di non aver usato soluzioni di IA generativa (come ChatGPT) per redigere atti e documenti oppure che il materiale generato da IA sia stato revisionato da esseri umani prima del deposito.

Questa proposta mira a garantire trasparenza e responsabilità nell'uso dell’IA da parte dei professionisti, promuovendo la consapevolezza umana sulla fallacia dell’intelligenza artificiale, su bias, allucinazioni e questioni etiche poste dall’uso di questi sistemi.

È verosimile immaginare che - in un prossimo futuro - dichiarazioni come queste saranno sempre più frequenti non solo in ambito forense, ma anche ogni volta che produrremo contenuti nell’ambito di un contratto, di un rapporto di collaborazione o, semplicemente, li posteremo sui social media.

Cominciamo noi dicendovi che i contenuti di questa newsetter non sono generati da un’IA. Se ci avvarremo di sistemi di IA in futuro, lo scriveremo chiaramente, assicurandovi di esaminare sempre accuratamente tutto quello che pubblicheremo. Promesso.

🔊 Un vocale da… Brando Benifei (Parlamento Europeo): nell’ultima settimana si è tanto parlato dell’AI Act, alla luce dell’accordo politico raggiunto tra le istituzioni europee. Nel vocale di questa settimana è direttamente il relatore del Regolamento al Parlamento Europeo che ci spiega le principali novità del provvedimento dopo la fine del trilogo.

📰 Le aziende italiane non sono pronte alla sfida dell’IA

CISCO ha presentato i risultati di un’indagine sullo stato di penetrazione dell'intelligenza artificiale nelle aziende dopo aver coinvolto 8.000 organizzazioni in circa 30 nazioni, di cui circa 200 in Italia.

Oltre l’80% delle aziende ritengono che l’IA avrà un impatto significativo sulle proprie attività e il 97% di esse ha affermato che l’urgenza di implementare tecnologie IA nelle proprie organizzazioni è aumentata negli ultimi sei mesi, con le infrastrutture IT e la sicurezza informatica indicate come aree maggiormente interessate. Nonostante questo, oltre il 75% delle aziende ha affermato che le proprie organizzazioni non dispongono di policy IA complete e meno del 40% ha messo in piedi processi di organizzazione interna.

E nel nostro Paese? Come è evidenziato nella sezione dedicata all’Italia se a livello globale solo il 14% delle società è pronto per l’AI, nel Belpaese questa cifra si riduce all’8%, con meno del 10% delle aziende che hanno messo in piedi processi di governance.

📰 La Guardia di Finanza utilizzerà l’IA contro l’evasione fiscale

Il Consiglio dei Ministri ha approvato in via preliminare il decreto legislativo, attuativo della riforma fiscale che modifica la disciplina in materia di accertamento tributario (qui è disponibile il testo integrale dello schema di decreto sottoposto a parere Parlamentare).

Tra gli ambiti toccati dal decreto c’è anche quello del potenziamento e del riordino delle attività legate all’analisi del rischio per le quali le istituzioni potranno utilizzare soluzioni di machine learning e intelligenza artificiale.

In particolare, una delle novità più rilevanti del decreto è che anche la Guardia di Finanza, oltre all’Agenzia delle Entrate, potrà utilizzare le informazioni presenti nell'anagrafe tributaria avvalendosi delle tecnologie, delle elaborazioni e delle interconnessioni con le altre banche dati di cui dispone.

L’IA sarà la vera svolta nella lotta all’evasione?

⚖️ UE: ecco come difendere i riders dagli algoritmi

Due anni dopo la presentazione della proposta legislativa della Commissione europea, le istituzioni dell'Unione hanno raggiunto un accordo sulla direttiva volta a garantire i diritti dei più di 28 milioni di riders, drivers e altri cittadini europei impiegati nella cosiddetta Gig economy.

Si tratta di una direttiva molto importante perché introduce le prime norme a livello europeo sulla gestione del lavoro tramite algoritmi e intelligenza artificiale.

Le nuove disposizioni (la documentazione relativa alla proposta legislativa è disponibile qui) dovrebbero consentire ai lavoratori digitali e ai loro rappresentanti di accedere alle informazioni sul funzionamento degli algoritmi e su come il loro comportamento influenzi le decisioni dei sistemi automatizzati.

Particolarmente rilevante è l'obbligo di attuare un controllo umano nelle decisioni cruciali, come licenziamenti o sospensioni di account, che non potranno essere prese senza supervisione umana. Ulteriori salvaguardie sono previste per il trattamento dei dati personali dei lavoratori da parte delle piattaforme, che non potranno superare i limiti strettamente legati allo svolgimento dell'attività lavorativa.

📲 HeyGen, l’AI che ci fa parlare tutte le lingue.

HeyGen è tool IA che consente la perfetta traduzione di video in altre lingue (tra cui inglese, anche con cadenza americana, turco, cinese, giapponese) preservando il timbro di voce della persona e sincronizzando il movimento labiale con precisione.

Lo strumento è in sé una vera rivoluzione dal momento che permette di abbattere ogni barriera comunicativa (si pensi all’utilizzo che potrebbero farne le pubbliche amministrazioni nei centri di prima accoglienza registrando un videomessaggio in lingue diverse) ma presta il fianco anche ad utilizzi malevoli come il deep fake. Sarebbe utile, alla stregua di Tik Tok, che anche quest’applicazione introducesse etichette per segnalare in modo trasparente che si tratta di un contenuto generato tramite IA.

Abbiamo esaminato “termini e condizioni” e “informativa privacy” di questo servizio made in USA per valutarne i contenuti e lasciarvi qualche spunto di riflessione.

Gli aspetti della privacy policy che ci hanno colpito sono:

- assenza di chiarezza delle basi giuridiche rispetto alle singole finalità di trattamento;

- possibilità per i minori di 13 anni di utilizzare l’app senza che sia predisposto un meccanismo di verifica.

Relativamente ai termini e condizioni invece ci è parso alquanto singolare il paragrafo dedicato alla manleva che prevede l’obbligo dell’utente di fornire ogni tipo di supporto o documento ad Hygen in caso di contestazioni di terzi ed esclude, senza il preventivo consenso scritto di HeyGen, che l’utente possa transigere rivendicazioni di terzi o rinunciare a qualsiasi difesa.

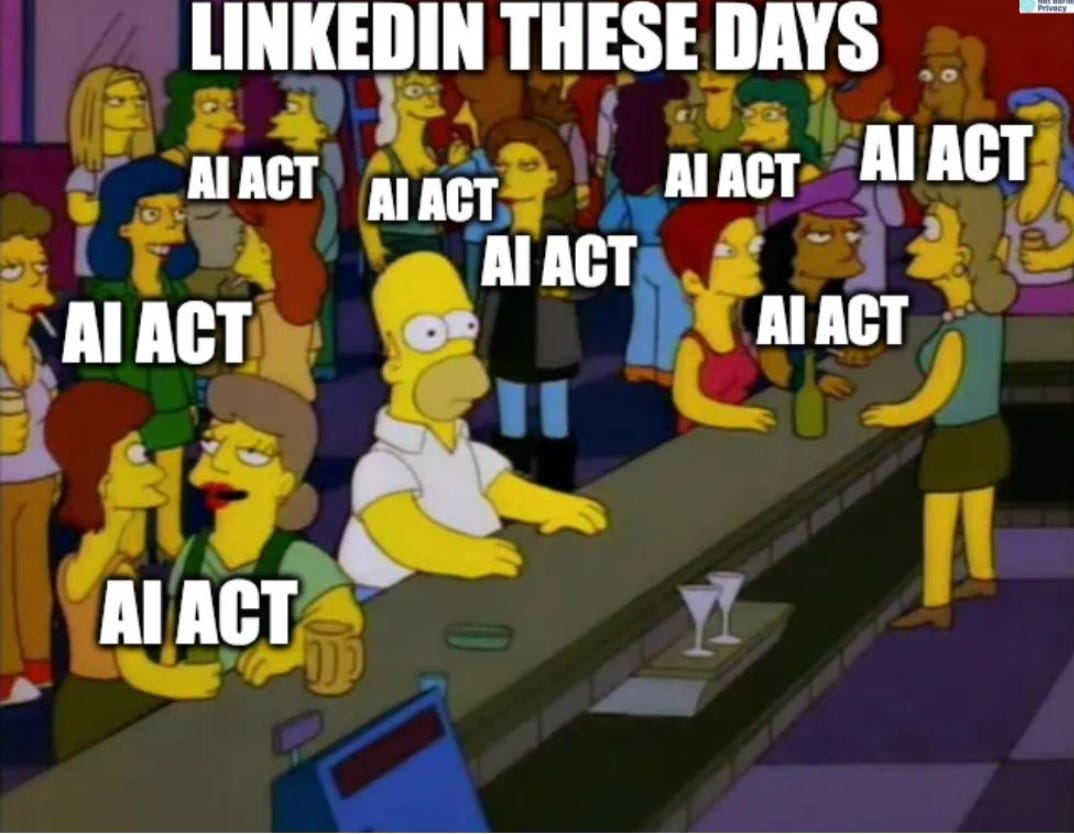

😂 IA Meme

È molto probabile che negli ultimi giorni, aprendo Linkedin, anche voi vi siate sentiti come Homer Simpson.

📚 Consigli di visione: "Pubblica" la docuserie di PAsocial

La pubblica amministrazione è pronta alla sfida dell’intelligenza artificiale? La domanda è forse retorica, dal momento che c’è grande bisogno di formazione e consapevolezza in merito a opportunità e rischi dell’IA.

Se ne occupa Pubblica, la prima docuserie italiana sulla comunicazione e informazione pubblica digitale realizata da PA Social, in collaborazione con Fondazione Italia Digitale, Binario F e Meta. Un intero episodio, il sesto, è dedicato all’IA e contiene i contributi di alcuni esperti (tra cui Ernesto Belisario).

Buona visione!

Per questa settimana è tutto, torniamo sabato prossimo. Se la newsletter ti è piaciuta, commenta o fai girare. Grazie!