🤖 L'IA distruggerà la creatività? – Legge Zero #32

Negli USA, le case discografiche hanno portato in giudizio due società di IA generativa. È l'ennesimo capitolo giudiziario di una saga che, fin qui, le norme vigenti non sono riuscite a placare.

🧠 Case discografiche Vs. IA generativa

I sistemi di intelligenza artificiale distruggeranno la creatività umana? È questa la tesi della discografia americana che, lo scorso 24 giugno, per mezzo della Recording Industry Association of America (RIAA), ha annunciato di aver intrapreso due azioni legali nei confronti della Suno, Inc., proprietaria della omonima piattaforma e della Uncharted Labs, Inc., proprietaria della piattaforma Udio AI.

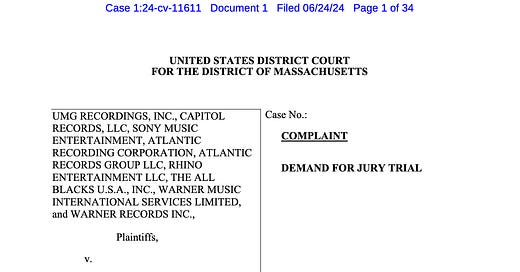

Le due piattaforme sono state citate in giudizio, rispettivamente dinanzi alla District Court del Massachussetts e al Southern District di New York, da alcune tra le maggiori etichette discografiche, tra cui Sony Music Entertainment, UMG Recordings e Warner Records.

Queste ultime lamentano che i provider di IA avrebbero copiato e registrato migliaia di brani musicali per addestrare i sistemi di intelligenza artificiale, in assenza di una licenza da parte delle case discografiche o degli autori dei brani.

Qui potete scaricare gli atti introduttivi dei due giudizi

È probabile che Suno e Udio AI si difenderanno invocando il fair use, l’eccezione che, nel copyright americano, consente di utilizzare le opere tutelate dal diritto d’autore, in assenza di autorizzazione, a condizione che ricorrano alcuni presupposti, tra cui le finalità di ricerca e di insegnamento. Le motivazioni, in sintesi, sono le stesse del caso New York Times (di cui avevamo scritto in LeggeZero #6 e LeggeZero #24).

Al di là dei tecnicismi giuridici, le etichette discografiche, nelle citazioni depositate contro i fornitori dei servizi di IA, affermano:

Questi servizi generano musica con tale velocità e su vasta scala, rischiando di inondare il mercato con musica generata da AI e di svalutare e sostituire il lavoro creato dagli esseri umani.

Quindi, il problema principale sarebbe quello della perdita di valore delle opere musicali e lo svilimento della creatività umana. La posizione è condivisibile e, tuttavia, fa sinistramente assomigliare il presente al recente passato, quando si sviluppò l’internet 2.0, con social network e piattaforme di distribuzione audio e video, come YouTube. Un passato nel quale l’industria culturale investì (e continua a investire) centinaia di milioni di euro nell’antipirateria e non dedica le medesime risorse all’innovazione e al supporto alla creatività.

Sul piano delle regole, la discussione si è polarizzata su opt-in vs. opt-out, sulla possibilità, cioè, che i titolari dei diritti impediscano agli sviluppatori di sistemi di intelligenza artificiale di utilizzare le proprie opere per le attività di allenamento delle macchine. L’AI Act, richiamando l’eccezione di text and data mining della Direttiva sul copyright del 2019, ammette questa facoltà, legittimando autori, editori, produttori e organismi di gestione collettiva a indicare che le proprie opere, seppur liberamente accessibili, non possano essere utilizzare per l’IA. Soluzione, al momento, di difficile applicazione pratica, in assenza di protocolli e standard condivisi, che legittimino e certifichino la volontà degli autori di escludere le proprie opere.

Eppure, in questo dibattito, sembra aleggiare, come un convitato di pietra, la remunerazione per l’industria culturale. Il passato recente insegna l’inutilità delle guerre fondate sul dogmatismo: difficile immaginare che le attività di pre-training e training possano costituire una violazione del diritto d’autore, considerando che queste utilizzazioni non dovrebbero rientrare nella nozione di atto di riproduzione.

Una scommessa all-in da parte delle case discografiche è pericolosa, perché, alla luce del contesto normativo attuale, c’è il rischio di perdere l’intera posta. Allo stesso tempo, immaginare che ogni singola utilizzazione di un brano musicale da parte di un sistema di intelligenza artificiale possa essere remunerato al pari di un passaggio televisivo e radiofonico, è irrealistico.

L’intelligenza artificiale è qualcosa che è, non che verrà. Non dobbiamo immaginarla come un mostro che possa distruggere l’umanità, a cominciare dalle sue espressioni creative, e arginarla non è una soluzione sostenibile sul lungo periodo: piuttosto, abbandonando inutili prove muscolari tra contendenti, potrebbe essere di gran lunga più utile ragionare di una ripartizione equa della ricchezza che genera.

🔊 Un vocale da… Francesco Schlitzer (Artisti 7607): cosa pensano gli artisti dell’IA? Cosa chiedono ai decisori e al legislatore? Nel vocale di questa settimana ce ne parla chi si occupa delle relazioni istituzionali per conto di un organismo di gestione collettiva dei diritti per il settore audiovisivo.

📰 La WIPO 🌐 pubblica un report sui brevetti dell’IA generativa

La World Intellectual Property Organization (WIPO) ha pubblicato un dettagliato rapporto sul panorama brevettuale dell'intelligenza artificiale generativa, intitolato ‘Patent Landscape Report: Generative Artificial Intelligence’. Si tratta di un documento molto interessante che fornisce una panoramica completa sulle attività di brevettazione e sulle pubblicazioni scientifiche nel campo dell'IA generativa.

Ecco alcuni dati interessanti:

1. Aumento dei brevetti e delle pubblicazioni scientifiche: Dal 2014 al 2023, il numero di famiglie di brevetti relativi alla IA generativa è aumentato da 733 a oltre 14.000, con un incremento significativo delle pubblicazioni scientifiche da 116 a oltre 34.000 nello stesso periodo. Soltanto nel 2023 sono stati depositati oltre il 25% di tutti i brevetti di IA generativa a livello globale e pubblicati oltre il 45% di tutti gli articoli scientifici in materia (l’impatto di ChatGPT è evidente).

2. Principali titolari di brevetti: Tra i principali detentori di brevetti si annoverano Tencent, Ping An Insurance Group, Baidu e IBM.

3. I Paesi protagonisti della ricerca: La Cina è in testa con oltre 38.000 famiglie di brevetti, seguita dagli Stati Uniti, dalla Corea del Sud, dal Giappone e dall'India (i Paesi UE sono indietro, l’Italia non è mai citata nel rapporto).

4. Applicazioni chiave della IA generativa: Le principali aree di applicazione sono relative a creazione di video, immagini, testi, audio e musica. Stanno crescendo molto - 78% di media annua negli ultimi cinque anni - i brevetti relativi all’ambito scientifico (molecole, geni e proteine).

📰 In UK 🇬🇧 200.000 persone sono state sottoposte a controlli a causa dell’errore di (chi ha realizzato) un algoritmo

Secondo quanto rivelato dal Guardian, nel Regno Unito, oltre 200.000 persone sono state erroneamente indagate per frode nell’erogazione di benefici abitativi, a causa di un errore dell’algoritmo del Department for Work and Pensions.

Secondo i dati ottenuti dall’organizzazione non governativa Big Brother Watch, migliaia di famiglie hanno subito indagini non necessarie basate sul giudizio, rivelatosi poi errato, di un algoritmo anti frode che aveva “etichettato” come potenzialmente ad alto rischio circa ⅔ delle richieste, rivelatesi poi pienamente legittime.

Oltre a un cospicuo esborso di soldi pubblici per i controlli, stimato in circa 4,4 milioni di sterline, questo ‘errore’ ha determinato che molte persone (innocenti) subissero indagini ingiuste e stressanti.

Questo caso dimostra che le tecnologie di IA non sono infallibili e che norme come l’AI Act servono per garantire che tali strumenti vengano utilizzati al meglio, prevenendo l'ingiusta criminalizzazione delle persone più vulnerabili (come coloro che fanno richiesta di sussidi pubblici).

⚖️ Non solo AI Act: il Consiglio dell'UE 🇪🇺 adotta un regolamento sulle ‘fabbriche di IA’ e sull'uso del supercalcolo nello sviluppo dell'IA

Il Consiglio dell'Unione Europea ha approvato definitivamente il nuovo regolamento che disciplina l'uso del supercalcolo per lo sviluppo dell'intelligenza artificiale (IA). Questo atto normativo - che modifica il regolamento (UE) 2021/1173 - ha l’obiettivo di potenziare le capacità di calcolo ad alte prestazioni (HPC) nell'UE, consentendo di recuperare il gap europeo nei confronti di Cina e USA.

Una delle principali novità è quella relativa alle ‘AI factories’, le fabbriche di IA che renderanno disponibile la capacità di supercalcolo dell'UE per soggetti pubblici, ma anche start-up e PMI innovative europee, in modo da addestrare i loro modelli di IA e sviluppare i loro progetti.

In attesa che venga pubblicato sulla Gazzetta Ufficiale UE, potete scaricare il regolamento qui sotto

⚖️ Il governo australiano 🇦🇺 pubblica il framework per l’uso dell’IA nel settore pubblico

Il governo australiano ha recentemente pubblicato un documento per garantire l'uso sicuro e responsabile dell'intelligenza artificiale da parte delle pubbliche amministrazioni.

Nonostante l’approccio sia molto più ‘leggero’ di quello UE - linee guida al posto di leggi - il modello adottato è sempre quello che consiste nella gestione del rischio (alla base anche dell’AI Act) e la definizione di IA è sempre quella OCSE (ormai un punto di riferimento globale).

Il documento mette in luce diverse buone prassi per dimostrare come le amministrazioni possano garantire un uso sicuro, responsabile ed etico dell'IA. Accanto alle best practices sono indicati i cinque pilastri per l’adozione di sistemi di IA nel settore pubblico:

definizione di un’organizzazione adeguata e approvazione di procedure per garantire uso etico (es. trasparenza, spiegabilità);

adozione di un approccio basato sul rischio per tutto il ciclo di vita di un sistema di IA;

definizione di processi per assicurare la qualità dei dati (e la privacy dei cittadini);

rispetto degli standard nazionali e internazionali in materia di IA;

attenzione alla fase di approvvigionamento dei sistemi di IA.

Il framework è disponibile qui.

😂 IA Meme

Anche voi siete così preccupati per quello che sta accadendo nel settore dell’IA?

😂 IA Meme che non lo erano

Phoenix, 19 giugno 2024. Un’automobile procede in modo strano, a zig-zag, poi imbocca una strada contromano. Un agente della locale polizia accende la sirena, raggiunge l’auto, (faticosamente) riesce a farla accostare ma… non c’è nessuno a bordo. Si trattava di un’auto Waymo, una compagnia di taxi a guida autonoma (che ha fornito giustificazioni per il malfunzionamento).

Il video ripreso dalla bodycam dell’agente è diventato subito virale. Sul verbale c’è scritto (a stampatello) “IMPOSSIBILE NOTIFICARE LA VIOLAZIONE AL COMPUTER”.

📚 Consigli di lettura: "Consent and Compensation: Resolving Generative AI’s Copyright Crisis" di Frank Pasquale e Haochen Sun

Nel primo piano di questa newsletter abbiamo parlato dell’ennesimo capitolo della ‘guerra dello scraping’ (fronte copyright).

La Law School della Cornell University ha pubblicato un saggio che contiene una proposta per fermare (o limitare) l'uso non consensuale delle opere sottoposte a diritto d’autore.

Il paper propone l’istituzione di un ‘equo compenso’, un'imposta sui fornitori di IA, da distribuire ai detentori di diritti d'autore le cui opere vengono utilizzate senza licenza. L’idea è nata per garantire che i content creator e le società che detengono i diritti ricevano una giusta quota dei (rilevanti) benefici economici derivanti dall’elaborazione dei contenuti all’IA.

Il meccanismo descritto nel saggio prevede anche un sistema di opt-out semplificato che consenta di richiedere facilmente le rimozione delle opere in caso di violazione del copyright.

Quale sarà il primo legislatore che accoglierà questa proposta?

L’articolo si scarica qui.

📚 Consigli di visione: ‘The Disruptors’: Sam Altman e Brian Chesky discutono con Lester Holt

Per capire cosa sta accadendo nel settore dell’IA è interessante ascoltare le parole dei protagonisti di questa rivoluzione, anche se talvolta intrise della retorica tipica della Silicon Valley.

In questa conversazione, Sam Altman (fondatore e CEO di OpenAI) e Brian Chesky (fondatore di Airbnb) discutono con il giornalista Lester Holt del potenziale dell'IA per rivoluzionare vari settori (tra cui quello dell’ospitalità), creando nuove opportunità.

I due affrontano anche il tema delle sfide etiche dell’IA e della sicurezza. Nel corso della conversazione, affermano l’importanza della trasparenza dell’IA e della collaborazione con i governi per assicurare un uso responsabile dell’intelligenza artificiale. Naturalmente, concordano sull’importanza delle regole. Non chiariscono quali però.

💡 L’IA fa cose

Sora - l’IA di OpenAI che genera video - non è ancora disponibile per tutti, ma è già stata utilizzata per la prima volta per realizzare uno spot (quello sulle origini di una catena di negozi di giocattoli). Eccolo.

Vi ricordate Figure01? Il robot umanoide della startup FigureAI a gennaio aveva imparato a fare il caffè (LeggeZero #7) mentre a marzo interagiva con un il fondatore della società grazie alla tecnologia di OpenAI, porgendogli una mela (LeggeZero #16). In questi mesi ha fatto tirocinio in uno stabilimento BMW dove si sta preparando ad essere impiegato nell’assemblaggio degli autoveicoli: impara così velocemente che sembra pronto per essere assunto. A furia di occuparsi solo di ChatGPT, forse le istituzioni hanno trascurato l’impatto sempre più rilevante della robotica nei processi produttivi (e sui posti di lavoro).

🙏 Grazie per averci letto!

Per ora è tutto, torniamo la prossima settimana. Se la newsletter ti è piaciuta, commenta o fai girare.

Chi piange per l'IA sta combattendo una guerra persa in partenza. Un po' come il copyright e internet. Si magari puoi vincere qualche causa...but..