🤖 Sono ancora vivo – Legge Zero #9

In India un algoritmo è stato ”letale" per migliaia di cittadini. In Italia è stata sospesa la gara per la piattaforma di assistenza sanitaria. Le amministrazioni non devono avere fretta con l'IA.

🧠 IA, si ma senza fretta

Dhuli Chand aveva 102 anni l'8 settembre 2022, quando si è messo alla guida di un corteo nuziale a Rohtak, una città dello stato di Haryana, nel nord dell'India. Come da consuetudine del posto, si è seduto su un carro con il vestito della festa, mentre una banda suonava alla presenza della sua famiglia e degli abitanti del villaggio.

Ma Chand non stava andando verso la sua sposa, bensì si stava recando da alcuni funzionari pubblici. Questa messa in scena gli serviva per dimostrare di essere vivo. Sei mesi prima, infatti, per un errore del sistema automatizzato usato dal governo dello stato, era stato (erroneamente) indicato come morto ed era stata sospesa l’erogazione della sua pensione.

Visto che proteste più canoniche non avevano funzionato, Chand e la sua famiglia hanno organizzato questa variopinta prova di esistenza in vita. Sul carro, l’anziano teneva in mano un cartello che nel dialetto locale diceva “vostro zio è vivo”. Dopo questa dimostrazione, finalmente è ripresa l’erogazione della pensione.

Questa storia, ai limiti dell’assurdo, è stata raccontata da Al Jazeera secondo cui non si è trattato di un caso isolato. Sarebbero infatti migliaia gli abitanti dichiarati erroneamente morti dal sistema e che stanno facendo di tutto per dimostrare di essere ancora vivi.

In un altro stato indiano, quello del Telangana, invece, migliaia di persone sono state lasciate senza il sussidio per ricevere cibo in quanto - sempre a causa di un mix esplosivo di dati scorretti e algoritmi non verificati – erroneamente ritenute prive dei requisiti per accedervi.

Quello che emerge dalle testimonianze è che l’algoritmo è ritenuto - evidentemente a torto - molto affidabile e quindi risulta molto difficile ottenere la correzione delle decisioni errate. Questo anche a causa del fatto che la riduzione dei controlli umani (prima la verifica era fatta casa per casa da funzionari dell’amministrazione) non è stata accompagnata da una riorganizzazione tesa ad assicurare un controllo e un monitoraggio dell’affidabilità dei sistemi. Il risultato è una percentuale di errore superiore al 7%. Non solo numeri, ma persone che da mesi non ricevono il cibo per poter sopravvivere.

Quanto sta succedendo in India deve costituire un monito affinché tutti comprendano che le opportunità offerte dall’IA, in termini di riduzione della corruzione e gestione efficiente dei processi, devono essere conciliate con un uso responsabile, specialmente in settori così critici per i cittadini.

È proprio a questo che servono le norme: assicurare che restino sempre al centro i diritti e le libertà delle persone ed evitare che la fretta nell’implementazione dell’IA possa trasformarsi in un boomerang, con cittadini furiosi e contenziosi da gestire.

In Italia, nei giorni scorsi, l’Agenas - Agenzia nazionale per i servizi sanitari regionali - ha sospeso, “in via cautelativa e temporanea”, la procedura di gara per un progetto PNRR da oltre 37 milioni di euro, la realizzazione della piattaforma di intelligenza artificiale a supporto dell’assistenza sanitaria primaria.

La sospensione è arrivata dopo una richiesta di chiarimenti dell’Autorità Garante per la protezione dei dati personali, evidentemente preoccupata che la realizzazione di questa piattaforma rispettasse le norme vigenti (es. con riferimento alla base giuridica del trattamento) e il recente provvedimento del Garante sul decalogo per progetti di IA in ambito sanitario.

Sicuramente le finalità della piattaforma sono più che apprezzabili, ma le amministrazioni devono assicurarsi di verificare adeguatamente i presupposti etici e normativi di fattibilità del progetto ben prima di avviare le procedure per l’acquisizione dei prodotti e servizi da usare nell’ambito di tali iniziative. Diversamente, potrebbe essere troppo tardi.

Per non parlare del fatto che l’ormai imminente approvazione dell’AI Act da parte dell’Unione Europea (di cui trovate l’ultima bozza qui ) dovrebbe spingere le amministrazioni che intendono avviare progetti di IA a iniziare già a verificarne la compatibilità con la normativa eurounitaria, anche per evitare che un successivo adeguamento possa essere inutilmente problematico ed eccessivamente oneroso (esponendo anche chi ha ignorato le norme che stanno per arrivare a responsabilità erariale).

Insomma, le amministrazioni non devono avere fretta, ma devono definire metodologie che siano rispettose delle norme e delle linee guida internazionali che si stanno moltiplicando per il contesto pubblico (in attesa di avere indicazioni da parte delle istituzioni italiane, in questo numero della newsletter vi segnaliamo alcuni documenti stranieri particolarmente interessanti).

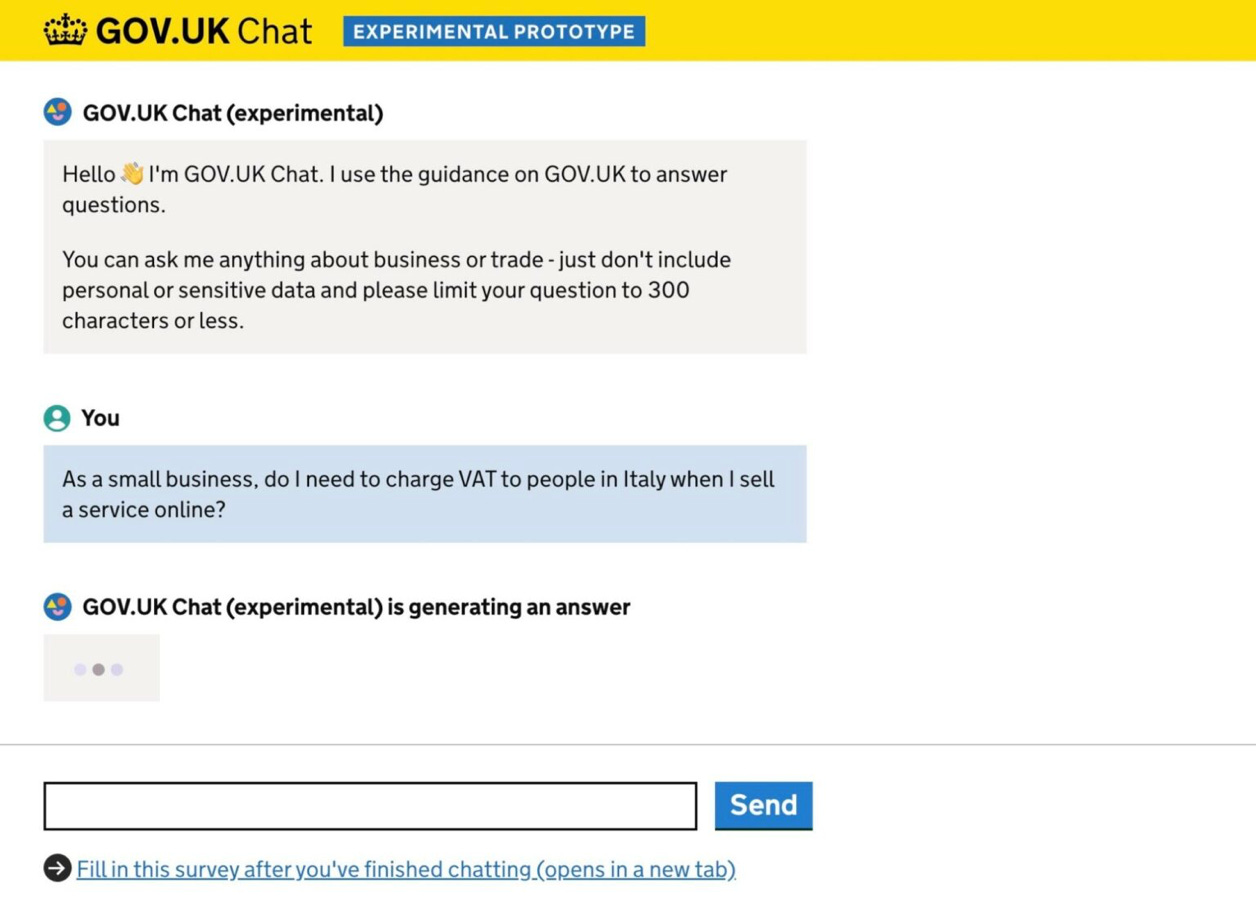

Appare poi doveroso affermare la necessità di una adeguata (e non frettolosa) fase di testing. Un buon esempio in questo senso è quello del Governo inglese dove il GDS (Government digital service) è impegnato nel progetto “GOV.UK Chat”, un chatbot che – utilizzando la tecnologia di OpenAI – possa essere implementato sul sito del Governo per fornire risposte utili ai cittadini.

Con un approccio assai trasparente (sicuramente da seguire) il GDS ha recentemente pubblicato i risultati di una fase di test durata qualche mese e che ha coinvolto un numero limitato di utenti. Il test ha documentato incredibili opportunità (il 70% degli utenti partecipanti alla sperimentazione ha dichiarato di aver ottenuto risposte utili e il 65% si è rivelato soddisfatto del servizio). Tuttavia, al momento, i test non sono stati ritenuti pienamente superati: le risposte del chatbot non sono affidabili come dovrebbero essere le indicazioni provenienti da un sito governativo. Pertanto, la sperimentazione proseguirà ancora, senza fretta, non escludendo il ricorso a soluzioni alternative.

L’amministrazione non può permettersi il lusso, pur di andare velocemente, di compromettere i diritti delle persone o di perdere la propria affidabilità e, quindi, la fiducia dei cittadini.

🔊 Un vocale da… Vincenzo Di Nicola (INPS): l’intelligenza artificiale è già presente in alcune amministrazioni che la stanno utilizzando da tempo. Il messaggio di questa settimana viene da chi ha curato una delle principali esperienze 🇮🇹, mettendo a fuoco uno degli aspetti più importanti per tutte le PA.

📰 L’OMS pubblica le Linee guida sull’uso dell’IA generativa in sanità

La sanità è senza dubbio uno dei settori in cui l’applicazione dell’IA generativa appare più promettente ma, al tempo stesso, più rischioso. Per questo motivo, l’Organizzazione Mondiale della Sanità ha pubblicato le proprie Linee guida su etica e governance dell’intelligenza artificiale generativa in ambito sanitario.

Le linee guida, frutto di un lavoro interdisciplinare, propongono un framework di raccomandazioni e principi guida - rivolti a tutti gli attori della governance sanitaria, dai decisori pubblici agli operatori sanitari - per mitigare i principali rischi connessi all’utilizzo dell’IA generativa in sanità. Il documento contiene anche un’interessante ricognizione delle principali applicazioni presenti e future, che comprendono non solo la diagnostica e il supporto alla ricerca e sviluppo, ma anche l’assistenza al paziente, la formazione dei professionisti e il management delle strutture sanitarie.

In attesa dell’entrata in vigore dell’AI act, le linee guida dell’OMS sono uno strumento di soft law destinato a diventare un importante punto di riferimento nel settore.

📰 Dal Governo 🇨🇭 una guida per utilizzare responsabilmente strumenti di IA generativa nel settore pubblico

La Svizzera già da alcuni anni sta ponendo grande attenzione al tema dell’intelligenza artificiale.

Il Governo ha recentemente pubblicato un documento contenente pratiche indicazioni per l’utilizzo di strumenti di IA generativa nell’amministrazione federale.

La scheda informativa specifica quali possono essere i principali casi d’uso, fornendo una serie di esempi e evidenziando come possano semplificare il lavoro dei dipendenti pubblici. È chiarito che la sperimentazione di tool di IA generativa deve però avvenire in maniera responsabile facendo attenzione a rispettare le policy di sicurezza e le norme relative alla protezione dei dati e verificando l’affidabilità dei dati.

⚖️ La Commissione 🇪🇺 si prepara all’AI Act e costituisce l’AI Office europeo

L’AI Act ancora non è stato formalmente approvato, ma la Commissione Europea ha già adottato un atto fondamentale per la governance continentale dell’IA.

Nei giorni scorsi, infatti, è stato costituito l’AI Office, l’Ufficio europeo che dovrà occuparsi di IA. La Commissione assegna all’Ufficio principalmente un ruolo di coordinamento e supporto per quanto riguarda l’applicazione delle norme sui sistemi di intelligenza artificiale all’interno della UE e il compito specifico di monitorare i mercati, anche internazionali, e lo sviluppo delle tecnologie. L’Ufficio è inoltre chiamato a monitorare l’emergere di rischi imprevisti derivanti dai più grandi LLM (come GPT di OpenAI) sulla base delle segnalazioni provenienti da un gruppo scientifico di esperti indipendenti.

Le sfide che attendono il nuovo Ufficio non sono semplici. Da un lato, dovrà diventare presto autorevole, attraendo professionalità e competenze di elevatissimo livello. Dall’altro dovrà essere capace di agevolare lo scambio di informazioni e la collaborazione tra le diverse autorità nazionali.

A proposito, quando avremo novità sulla governance italiana?

💡 L’IA fa cose

Eravamo stati facili profeti nel #8 di LeggeZero: negli USA migliaia di elettori hanno ricevuto la telefonata di un finto Joe Biden che li invitava a non andare a votare alle primarie. Il messaggio era un deepfake.

😂 IA Meme

A proposito di IA, fake e campagne elettorali. Questa volta è stato direttamente Donald Trump che - sul suo social network (Truth) - ha ripostato un’immagine che lo ritrae mentre prega in chiesa. Peccato che sia un falso clamoroso generato con l’IA (ha sei dita per mano). Se ne sarà accorto?

📚 Consigli di lettura: "Ethical Governance of Artificial Intelligence in the Public Sector" di Liza Ireni-Saban e Maya Sherman

Non si può pensare che l’uso di sistemi di IA in ambito pubblico sia solo un tema tecnologico: è cruciale la valutazione etica che ponga al centro l’essere umano, il cittadino, e la cura dell’interesse pubblico.

Il testo "Ethical Governance of Artificial Intelligence in the Public Sector" (in inglese) rappresenta un buon punto di partenza per chi voglia definire una metodologia sostenibile per l’implementazione di sistemi di IA in ambito pubblico. Le autrici - ricercatrici esperte su questi temi - propongono un approccio relazionale, trasparente e flessibile, giungendo alla conclusione per cui i principi etici non sono ormai più sufficienti, ma servono le regole.

📚 Consigli di visione: AI - Amministrazione intelligente (il primo webinar di LeggeZero)

Due ore ricchissime di spunti, riflessioni, domande ed esperienze. Troverete questo nella registrazione del nostro primo Webinar dedicato proprio alle sfide dell’uso dell’intelligenza artificiale nella pubblica amministrazione.

📢 Nel corso dell’incontro - con oltre 1.500 iscritti - abbiamo affrontato diversi aspetti legati all'adozione di sistemi e soluzioni di IA nel settore pubblico.

🔗 Con

🔗 Con abbiamo parlato del ruolo dei dati, fondamentali per utilizzare sistemi di IA.

🔗 Con Alessandro Greco (ACN) abbiamo analizzato gli aspetti connessi alla sicurezza dei sistemi di IA.

🔗 Con Marta Colonna (PagoPA) abbiamo cercato di capire come l'IA possa essere utilizzata per migliorare i servizi pubblici e quali approcci possono seguire le amministrazioni.

🔗 Con Vincenzo Di Nicola (INPS) abbiamo analizzato una delle più avanzate esperienze italiane in materia di utilizzo dell’IA nel settore pubblico.

Qui sotto trovate il video con la registrazione. Buona visione!

📣 Eventi

L'intelligenza artificiale nella P.A. Opportunità e sfide - Torino, 7.2.2024

AI Festival - Milano, 14-1 .2.2024

L’intelligenza artificiale a supporto del lavoro parlamentare - Roma, 14.2.2024

Per questa settimana è tutto, torniamo sabato prossimo. Se la newsletter ti è piaciuta, commenta o fai girare. Grazie!

Bè...a noi, in certi casi, ci chiedono una autodichiarazione di "esistenza in vita".

Mia madre, nel farlo, mostrava le corna..

;)