🤖 Legge Zero #1 - Spoiler alert: quello di Hollywood non sarà l’ultimo sciopero contro l’IA

Dopo l’accordo di sceneggiatori e attori con i produttori, la regolamentazione dell’uso dell’intelligenza artificiale nel rapporto di lavoro diventerà tema di contrattazione in tutti i settori.

🧠 Sciopereremo anche noi contro l’IA?

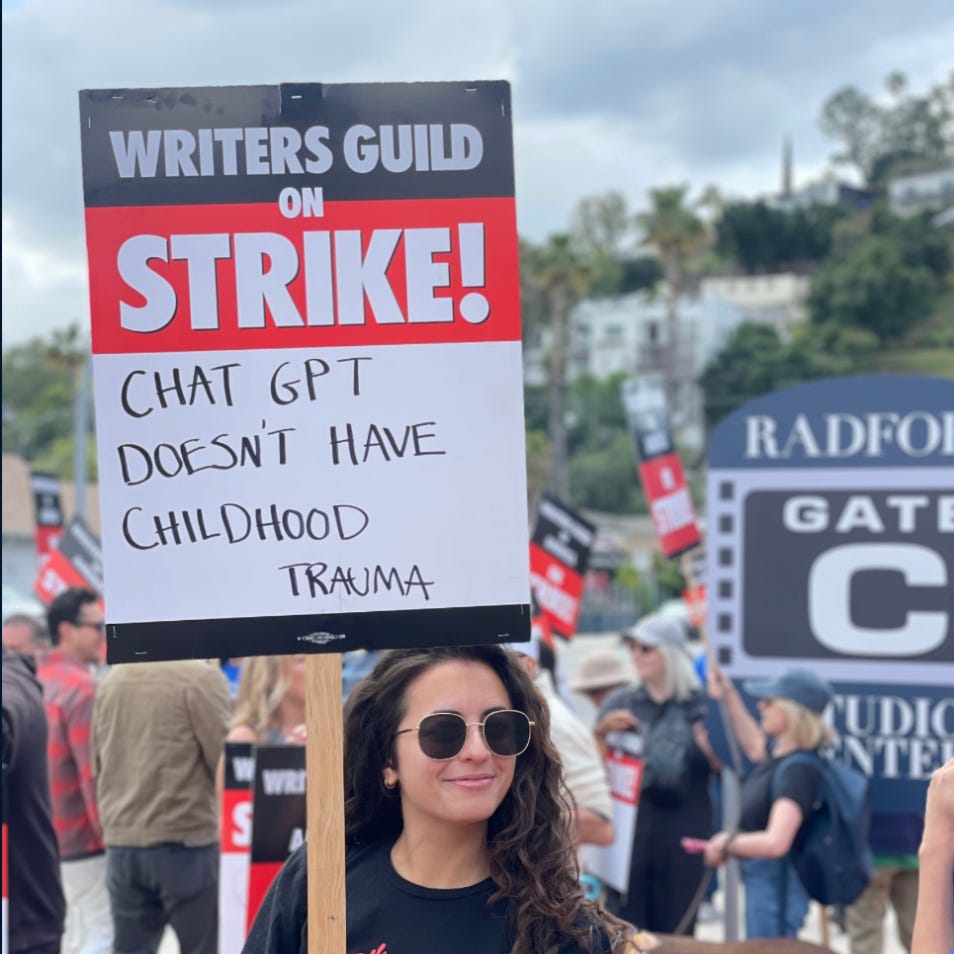

148 giorni. Tanto è durato lo sciopero dei lavoratori del settore cinematografico e televisivo statunitense, quello che – insieme all’astensione dal lavoro degli sceneggiatori – sarà ricordato come la prima grande protesta sindacale contro l’intelligenza artificiale.

Per il suo impatto sulle vite di tutti noi (i ritardi sulle uscite dei film o delle nostre serie preferite), è stato un evento che ha monopolizzato l’attenzione dei media: una manifestazione compatta, dura, come non se ne vedevano da decenni, che ha portato a due distinti accordi, rispettivamente, tra l’associazione rappresentativa degli attori e quella degli sceneggiatori con i produttori cinematografici e televisivi. E qual era uno dei principali terreni di scontro della protesta se non i rischi connessi all’intelligenza artificiale e alla forte contrazione delle opportunità e delle condizioni di lavoro dei lavoratori – non tutti strapagati – dell’industria dell’intrattenimento?

Basti pensare al deaging di Harrison Ford nell’ultimo capitolo della saga di Indiana Jones, “Il quadrante del destino”, realizzato per mezzo di un complesso di tecnologie, tra cui un sistema che aveva “imparato”, con un processo di machine learning, le espressioni del volto dell’attore, generando poi le sue facce con un ringiovanimento di oltre quarant’anni. Ford, infatti, ha 81 anni nella realtà, ma solo 35 nei primi minuti del film e tutto questo senza dover ricorrere ad altri attori, come nel passato, ma riproducendo le sue immagini con una sorta di lifting generato dall’intelligenza artificiale.

Uno scenario distopico, perché, se abbandoniamo il tecno-entusiasmo che troppe volte vizia con la novità la nostra percezione, non possiamo non notare che una casa di produzione, acquistando i diritti di immagine di un attore, potrebbe ricreare una recitazione infinita, anche al di là della vita biologica dell’attore stesso. Un bel risparmio di spesa per chi investe nel cinema, ma, se si ribalta la prospettiva, una svendita dei diritti degli attori e degli altri lavoratori (pensate agli sceneggiatori che potrebbero essere, almeno in parte, sostituiti dall’uso di intelligenze artificiali generative).

Il sindacato ha ottenuto non solo che non sia attribuito valore creativo alle sceneggiature scritte con l’intelligenza artificiale generativa, ma anche che non possano essere negoziati accordi che consentano alle case di produzione di ridurre i compensi degli sceneggiatori che lavorano su bozze realizzate per mezzo dell’AI. Allo stesso tempo, nell’accordo degli attori, è previsto che l’IA possa essere utilizzata per creare una replica digitale solo previo loro consenso espresso e pagando uno specifico compenso. Sicuramente un passo in avanti, ma è facile prevedere che – presto – i provini saranno aperti solo agli aspiranti attori che saranno disposti a dare questo consenso e che, tranne le star, che saranno in condizione di poterlo negare liberamente, per gli interpreti emergenti sarà molto difficile affermarsi senza accettare di essere replicati (guadagnando di meno e quindi perdendo presto il controllo sulla propria immagine).

Sotto questo profilo, quanto accaduto a Hollywood potrebbe essere la distopica anteprima di quanto aspetta tante categorie di lavoratori: dai giornalisti agli impiegati, dai contabili ai grafici. Tutte categorie che potrebbero essere messe a rischio non dall’intelligenza artificiale in sé, ma da un uso eccessivo della stessa per ridurre al minimo i costi dell’attività imprenditoriale, mortificando ruolo e retribuzioni degli esseri umani (in India un imprenditore ha sostituito il 90% dei suoi dipendenti mediante il ricorso all’IA).

Come possiamo arginare questa deriva?

In tanti intravedono nell’AI Act, il regolamento europeo che dovrebbe disciplinare l’intelligenza artificiale, la panacea per ogni preoccupazione. Eppure, nel testo che si sta discutendo non esiste una singola disposizione sul diritto d’autore o sui diritti di immagine. Certo, nella sua ultima versione, l’AI Act prevede l’obbligo, per chi utilizza queste tecnologie, di palesare le modalità con cui è stato “allenato” il sistema: quindi, bisognerebbe rendere trasparenti le fonti, rivelando testi, immagini, suoni che hanno educato il sistema di intelligenza artificiale, rendendolo capace di generare nuovi contenuti.

Una risposta però ancora insoddisfacente, se poi si riflette sulla circostanza che siamo al cospetto di una semplice utilizzazione di contenuti e non – in termini giuridici – di una riproduzione, tutelabile dalle regole del diritto d’autore.

Last but not least, chi può essere considerato l’autore di una sceneggiatura creata da un’intelligenza artificiale generativa? Chi possiede o ha istruito la tecnologia? Chi immette le chiavi di ricerca per generare un nuovo testo? Anche su questo, per ora, l’incertezza regna sovrana.

Non si vuol negare che un intervento legislativo sia necessario. Però, da sola, la legge non basta. Sicuramente, in questo settore, saranno importantissimi i contratti. L’esperienza di Los Angeles e degli studios di Hollywood insegna che non dobbiamo attendere una legge, che potrebbe intervenire quando oramai i giochi sono fatti. Servono accordi sindacali e di categoria, qualcosa che impedisca di ridurre iniquamente il costo del lavoro.

La protesta appena conclusa sarà quindi probabilmente solo il primo di una lunga serie di episodi che vedranno da ora in poi le contrattazioni sindacali concentrarsi non solo sui temi tradizionali (paga, ferie, condizioni di lavoro) ma anche sull’impatto che l’uso dell’intelligenza artificiale da parte del datore di lavoro avrà su retribuzione e mansioni dei dipendenti.

Il finale, però, non è ancora scritto.

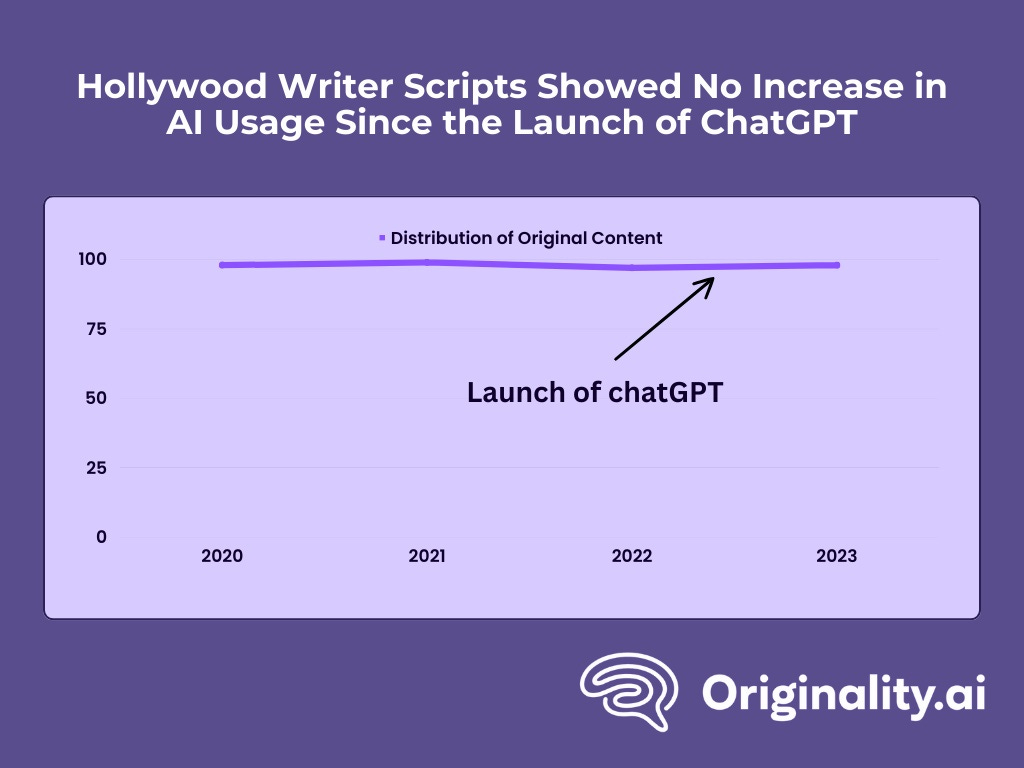

P.S. Secondo una indagine di Originality.ai, per ora, pochissimo di quello che vediamo sui nostri schermi, meno del 5%, è stato generato attraverso IA.

🔊 Un vocale da… Marco Bentivogli (esperto di politiche di innovazione dell’industria e del lavoro.): cosa rappresentano gli accordi raggiunti tra produttori e lavoratori di Hollywood? Possono essere un modello anche per gli altri lavoratori? Le previsioni reggeranno alla rapidissima evoluzione della tecnologia? Nel vocale della settimana, un ospite d’eccezione risponde a queste domande.

📰 Argentina: com’è andata la prima campagna elettorale dell’era dell’IA?

Da pochi giorni Jaiver Milei è il nuovo Presidente dell’Argentina. Notizia rilevante non solo dal punto di vista politico ma anche perché - come ha riportato il New York Times - la campagna elettorale è stata una delle prime in cui i candidati (e i loro sostenitori) hanno usato l’intelligenza artificiale per manipolare immagini e video dei rivali in modo da metterli in difficoltà e danneggiarli, alterando la percezione degli elettori.

È tempo quindi di aggiornare urgentemente le regole delle campagne elettorali per evitare che i deep fakes possano alterare lo svolgimento delle elezioni e quindi la vita delle nostre democrazie.

📰 AI Act: fa discutere la proposta di Germania, Francia e Italia sui foundation models

Non è rimasto molto tempo per chiudere i triloghi, cioè i negoziati interistituzionali in corso sulla proposta di regolamento europeo sull’intelligenza artificiale.

Uno degli ostacoli su cui rischia di naufragare la proposta di AI Act è la regolamentazione dei foundation models (i modelli alla base delle tecnologie di IA generativa, come il large language model alla base di ChatGPT). Si tratta di componenti essenziali delle soluzioni di IA e qualcuno teme che una regolamentazione eccessiva possa costituire un limite agli sviluppi successivi.

Nei giorni scorsi ha suscitato molto clamore, dunque, la notizia del raggiungimento di un accordo tra Germania, Francia e Italia, che prevederebbe, tra le altre cose, l’esclusione dei foundation models dall’ambito di applicazione dell’AI Act.

L’accordo trilaterale potrebbe dare una forte spinta verso la definitiva e tanto attesa approvazione del Regolamento, ma c’è stata una fortissima presa di posizione di molte organizzazioni della società civile (come Privacy Network, The Good Lobby Italia e Hermes Center) che hanno chiesto al Governo italiano di rivedere la propria posizione, sottolineando come i foundation models presentino “rischi significativi data la loro complessità, scala e pervasività, ed in particolare per la loro potenzialità intrinseca di formare un'infrastruttura centrale per le applicazioni successive”.

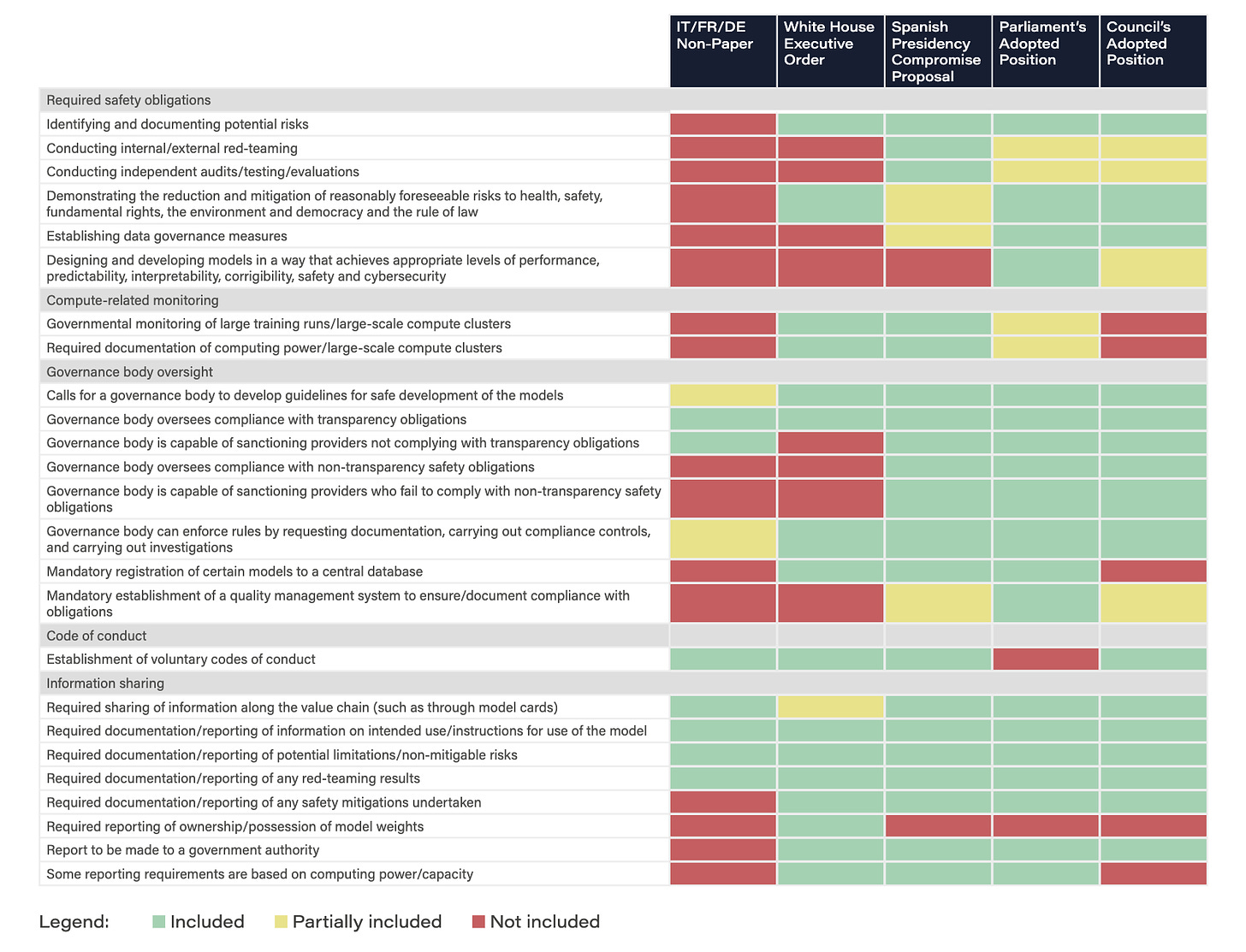

Per chi voglia farsi un’idea di quali siano le garanzie che verrebbero meno- e sono diverse - se questa proposta venisse accolta, qui sotto una efficace grafica del Future of Life Institute.

⚖️ Il Garante Privacy indaga sull'uso dei dati per l'IA

Il Garante per la protezione dei dati personali - dopo il provvedimento su ChatGPT dello scorso marzo - continua ad occuparsi di IA. Nei giorni scorsi avviato un'indagine conoscitiva sulla raccolta di dati personali online per addestrare algoritmi di intelligenza artificiale.

L'obiettivo è verificare le misure di sicurezza adottate da siti pubblici e privati per prevenire la raccolta massiva (webscraping) di dati personali. Si tratta di un’iniziativa importante che va nell’ottica di assicurare la massima trasparenza - e quindi consapevolezza - sul funzionamento degli algoritmi.

A seguito dell'indagine, l'Autorità si riserva di adottare i necessari provvedimenti, anche in via d'urgenza, per garantire la protezione dei dati personali nell'ambito dell'uso dell'intelligenza artificiale.

⚖️ Sentenze sul fisco: arriva il giudice robot?

Il progetto Prodigit del Ministero dell’Economia e delle Finanze impiega la tecnologia digitale e l'intelligenza artificiale per prevedere gli esiti futuri dei futuri contenziosi in base all'analisi di oltre un milione di sentenze tributarie.

Tra gli obiettivi del progetto c’è la sperimentazione attraverso l’IA di un modello di prevedibilità della decisione e l'implementazione della banca dati nazionale di giurisprudenza tributaria, che conterrà le sentenze di merito integrali, oscurate.

L'algoritmo sarà addestrato da un team composto da 23 giudici tributari selezionati dal Ministero dell'Economia e 7 studiosi esperti del settore. Ma cosa significa in concreto? Le motivazioni delle sentenze saranno scritte dall’IA sulla base delle sentenze precedenti? Quali precauzioni saranno adottate per garantire il rispetto dei principi etici e preservare le intuizioni umane che - da sempre - consentono di applicare le norme in modo evolutivo? Staremo a vedere.

📲 Glaze: come proteggere le proprie opere dall’IA

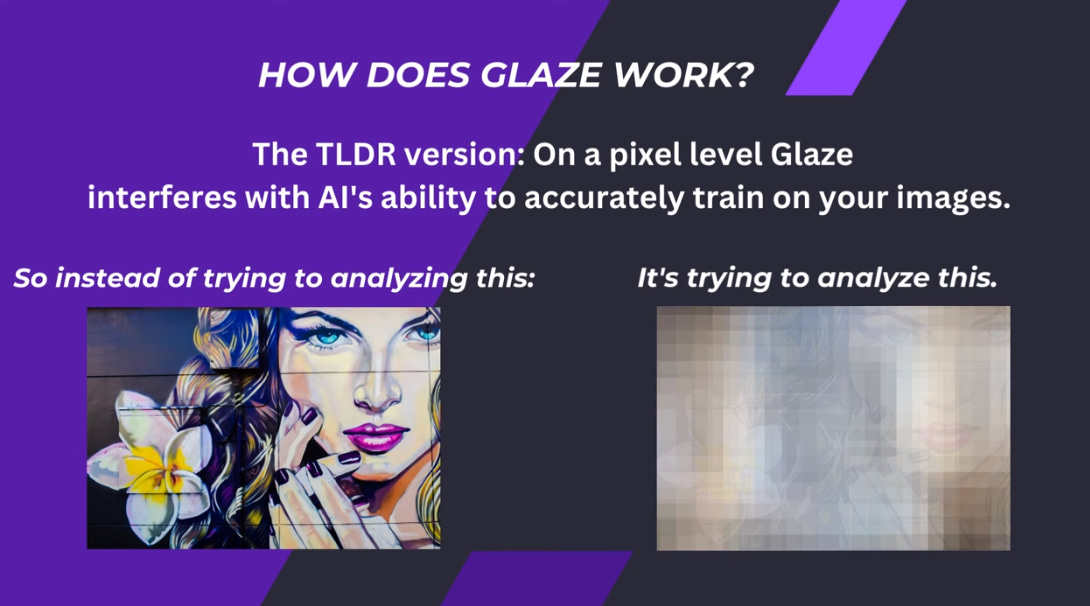

L’apposizione del simbolo © in calce ad un contenuto (es. un articolo, una canzone, un’immagine) è sufficiente a bloccare la pesca a strascico delle tecnologie dell’intelligenza artificiale? La risposta è no. Per questo, in attesa di nuove regole a tutela degli autori, i ricercatori dell’Università di Chicago hanno sviluppato Glaze.

Si tratta di un sistema gratuito progettato per proteggere gli artisti umani dagli impatti negativi della mimesi stilistica da parte dei modelli di intelligenza artificiale generativa. Questi modelli, infatti, sono utilizzati per replicare gli stili degli artisti senza il loro consenso. Glaze interviene apportando minimi cambiamenti alle opere d'arte, cambiamenti che sono invisibili agli occhi umani ma alterano significativamente la percezione dello stile da parte dei modelli IA.

😂 IA Meme

L’accordo tra produttori e sceneggiatori di Hollywood visto da Fry di Futurama.

📚 Cosa legge Barack Obama?

I grandi della terra si stanno occupando di IA con sempre maggiore interesse: dichiarazioni pubbliche, incontri internazionali, proposte di regolazione e atti normativi. Ma cosa leggono e dove studiano per capire questo fenomeno prima di parlarne e pensare di regolarlo?

Nei giorni scorsi l’ex Presidente USA Barack Obama ha pubblicato una lista di fonti (libri, articoli e podcast) che hanno influenzato la sua visione dell’intelligenza artificiale. Un elenco prezioso per chi vuole approfondire i temi dell’IA e dei suoi impatti etici e sociali, ma anche un esempio da seguire per altri politici e rappresentanti delle istituzioni (per evitare proposte normative slegate da qualsiasi compiuta conoscenza di questa realtà così complessa).

💼 Eventi e incontri

Progettare la didattica con l’intelligenza artificiale - Webinar, 28.11.2023

AI FAIR, la Fiera internazionale sull’intelligenza artificiale - Bologna, 5-7.12.2023

Per ora è tutto, torniamo sabato prossimo. Se la newsletter ti è piaciuta, commenta o fai girare. Grazie!