🤖 Fate gli idraulici, non gli avvocati! - Legge Zero #79

Il premio Nobel Hinton esorta i giovani a fare lavori manuali che, per ora, non saranno sostituiti dall'IA. A differenza delle professioni intellettuali - come quella forense - che sono a rischio.

🧠 Solo io, una stampante e ChatGPT

Non avrei mai pensato di dirlo, ma ChatGPT mi ha praticamente guidato passo passo nella vittoria di una causa civile. Dovevo effettuare un recupero crediti e, invece di pagare un avvocato, ho usato ChatGPT per scrivere la lettera di diffida, compilare i moduli da presentare in tribunale e persino prepararmi per l'udienza.

Alla fine, ho vinto la causa e mi sono appena stati pagati 3,707 dollari.

Nessun avvocato. Solo io, una stampante e ChatGPT.

Mi ha persino aiutato a capire come riscuotere i soldi. Mi ha decisamente fatto risparmiare migliaia di dollari. L'IA è pazzesca!

Questo è il post di un utente statunitense di Reddit che sta facendo molto discutere. Da un lato, infatti, c’è una storia a lieto fine: un cittadino che - armato solo di un chatbot, magari nella sua versione gratuita - riesce a tenere testa a un debitore e a un sistema giudiziario complesso (anche perché, siamo onesti, chi è davvero contento di pagare un avvocato?). Dall’altro, però, altri utenti hanno fatto notare che ci sono molti rischi: i consigli legali dei chatbot non sono sempre affidabili (colpa delle ormai famose “allucinazioni”) e poi, in caso di errore, ChatGPT e gli altri servizi prevedono clausole specifiche di esenzione della responsabilità. Insomma, l’avvocato dei sogni (automatizzato, che costa pochissimo e risponde immediatamente alle richieste del cliente) non ha norme deontologiche da rispettare e - in caso di errore - non ne risponde, cioè non risarcirà il danno subito dal cliente.

Insomma, l’utente di Reddit è stato fortunato, probabilmente agevolato dalla semplicità della causa (un recupero crediti di modesta entità). Ma in controversie più complesse, affidarsi ciecamente a un chatbot potrebbe portare a pasticci procedurali o errori di cui nessuno risponderebbe. Almeno per ora.

Ma in futuro? È verosimile pensare che - a seguito del progresso dell’IA e della creazione di chatbot specializzati, magari iscritti in una sezione specifica dell’albo dedicata agli algoritmi coperti da polizza per i danni cagionati in caso di errore - i codici di procedura consentiranno alle persone fisiche di stare in giudizio personalmente se assistiti dall’IA per alcuni tipi di cause? Se si, per quali giudizi? In attesa di capirlo, è scontato che nel frattempo l’IA sia utilizzata sempre più per gran parte dell’attività stragiudiziale: dalle liti condominiali alle controversie assicurative, dalle istanze verso la pubblica amministrazione alla predisposizione di accordi e contratti.

Il mercato dei servizi legali cambierà, sicuramente, come tutti. E cambieranno anche gli studi legali che - progressivamente - useranno l’IA per erogare in modo più efficiente e veloce i propri servizi.

E si, se ci state pensando, questo significa che ci sarà una perdita di posti di lavoro. Spoiler: serviranno meno professionisti, specialmente quelli più giovani.

A dirlo è nientemeno che Geoffrey Hinton - il padrino dell’IA e premio Nobel 2024 per la fisica - noto per i suoi allarmi relativi ai rischi dell’intelligenza artificiale. L’ultimo, interessante per tutti, riguarda proprio i posti di lavoro.

Secondo Hinton, le professioni intellettuali e i lavori d’ufficio, specie quelli più routinari, saranno travolti dall’IA ben prima dei lavori manuali. È un ribaltamento dello stereotipo della rivoluzione industriale per cui le “macchine rubano il lavoro in fabbrica”: stavolta a tremare dovrebbero essere impiegati, analisti, addetti al customer service, operatori dei call center, giuristi e giovani avvocati, ma non idraulici o muratori.

In un’intervista nel podcast “The Diary of a CEO” (la trovate qui sopra, dura un’ora e mezza), Hinton ha dato un consiglio provocatorio ai giovani: «Diventate idraulici!». Ha spiegato: “passerà molto tempo prima che l’IA diventi brava nel maneggiare gli oggetti quanto lo siamo noi, quindi scommettere sul diventare idraulico è una buona idea”.

Detto da uno scienziato, suona quasi paradossale. Ma il ragionamento è chiaro: un lavoro come l’idraulico richiede abilità manuali complesse, adattamento a situazioni impreviste, problem-solving “sul campo”, tutte cose in cui le IA hanno ancora enormi difficoltà. Riparare una perdita d’acqua in un vecchio palazzo implica movimenti in spazi ristretti, capire la situazione utilizzando molti sensi contemporaneamente, trovare soluzioni creative: un insieme di capacità che nessun algoritmo possiede per ora. È il tipo di mestiere che potrebbe sopravvivere anche in un futuro in cui molte professioni da scrivania saranno automatizzate.

Al contrario, sostiene Hinton, molti lavori impiegatizi che consistono in compiti ripetitivi e seguono regole fisse sono altamente automatizzabili. L’esempio che il premio Nobel fa durante il podcast viene proprio dall’ambito legale: le figure più junior negli studi legali che passano la giornata a spulciare documenti, riassumere casi, cercare riferimenti normativi o giurisprudenziali. Sono attività che l’IA già oggi può svolgere: esistono tool in grado di predisporre la bozza degli atti, riassumere contratti, persino prevedere - in base ai dati dei giudizi passati - quale potrebbe essere l’esito di una causa. Stessa sorte potrebbe toccare a operatori di call center e supporto clienti, addetti all’inserimento dati, impiegati amministrativi che popolano fogli Excel, giornalisti da desk (che rielaborano le agenzie): tutti ruoli che lavorano secondo schemi ripetibili e che sono tra i primi che possono essere sostituiti da un algoritmo ben addestrato.

Attenzione: Hinton aggiunge che non stiamo parlando di uno scenario fantascientifico del 2040, sta già accadendo ora. Molti dei lavori per neolaureati sono tutti compiti che possono essere svolti da modelli che non dormono, non vanno in ferie, non scioperano e non chiedono aumenti.

Discorso diverso meritano i lavori manuali o che richiedono competenze strategiche: artigiani, tecnici, operatori sanitari, manutentori, ma anche avvocati e consulenti esperti. Nessuno è totalmente al riparo nel lungo termine, ma nell’immediato è più facile che un’IA sostituisca un data analyst mediocre piuttosto che un bravo elettricista. Anche molti mestieri artigianali specializzati (un restauratore, un sarto) sono difficili da automatizzare perché richiedono quella maestria manuale e quella creatività adattiva che le macchine non hanno. E poi ci sono i lavori in cui l’elemento umano e relazionale è centrale: ad esempio, l’insegnante (un chatbot può fornire conoscenze, ma motivare e comprendere empaticamente uno studente è un’altra storia), oppure il manager che guida un team (attività in cui conta la leadership e la visione). Questi ruoli potranno essere supportati dall’IA, ma difficilmente rimpiazzati nell’immediato.

Ma cosa significa davvero essere sostituiti da un algoritmo? Non immaginiamoci necessariamente robot umanoidi che ci rubano la sedia in ufficio. Più realisticamente, molte persone verranno affiancate da assistenti IA che faranno il grosso del lavoro, lasciando agli umani solo la supervisione finale. Hinton stesso prevede che in molti ruoli - anche negli studi legali - un unico lavoratore con l’IA potrà fare il lavoro che prima richiedeva dieci persone. Non a caso, alcuni segnali già si vedono: il premio Nobel cita il calo delle assunzioni di neolaureati nel settore tecnologico, dove aziende come Meta e Google nel 2024 hanno ridotto del 25% la quota di nuovi assunti, in parte grazie all’automazione resa possibile dall’IA.

Sarà quindi sempre più difficile entrare nel mondo del lavoro, dal momento che sempre meno aziende o studi professionali avranno voglia di farsi carico della formazione e dell’addestramento di risorse junior.

Hinton inoltre avverte: anche se in una società ideale l’automazione dovrebbe migliorare la vita di tutti, nella realtà c’è il rischio che chi verrà sostituito dall’IA stia peggio, se non ci saranno meccanismi di supporto e riqualificazione. L’equazione è semplice: se una società rimpiazza 50 esperti legali con un sistema di IA, il vantaggio economico andrà all’azienda (o ai suoi clienti), mentre i 50 professionisti rimasti a casa subiranno il danno. Senza politiche di compensazione e redistribuzione della ricchezza, si rischia di ampliare le disuguaglianze sociali: da un lato proprietari e sviluppatori di IA arricchiti dalla maggiore produttività, dall’altro una fascia di lavoratori espulsi (che non ha avuto il tempo di lavorare a un “piano B”).

E poi, anche introducendo strumenti come il reddito universale minimo (che Hinton stesso considera un’ipotesi necessaria), un problema resterebbe: “Quale scopo avranno le persone nella vita, se il lavoro viene meno?”. La perdita del lavoro, infatti, non sarà solo economica ma identitaria e psicologica.

Sono temi - purtroppo assenti dalla discussione politica - che diventeranno presto cruciali e su cui serviranno normative e politiche globali, nazionali, deontologiche.

💊 IA in pillole

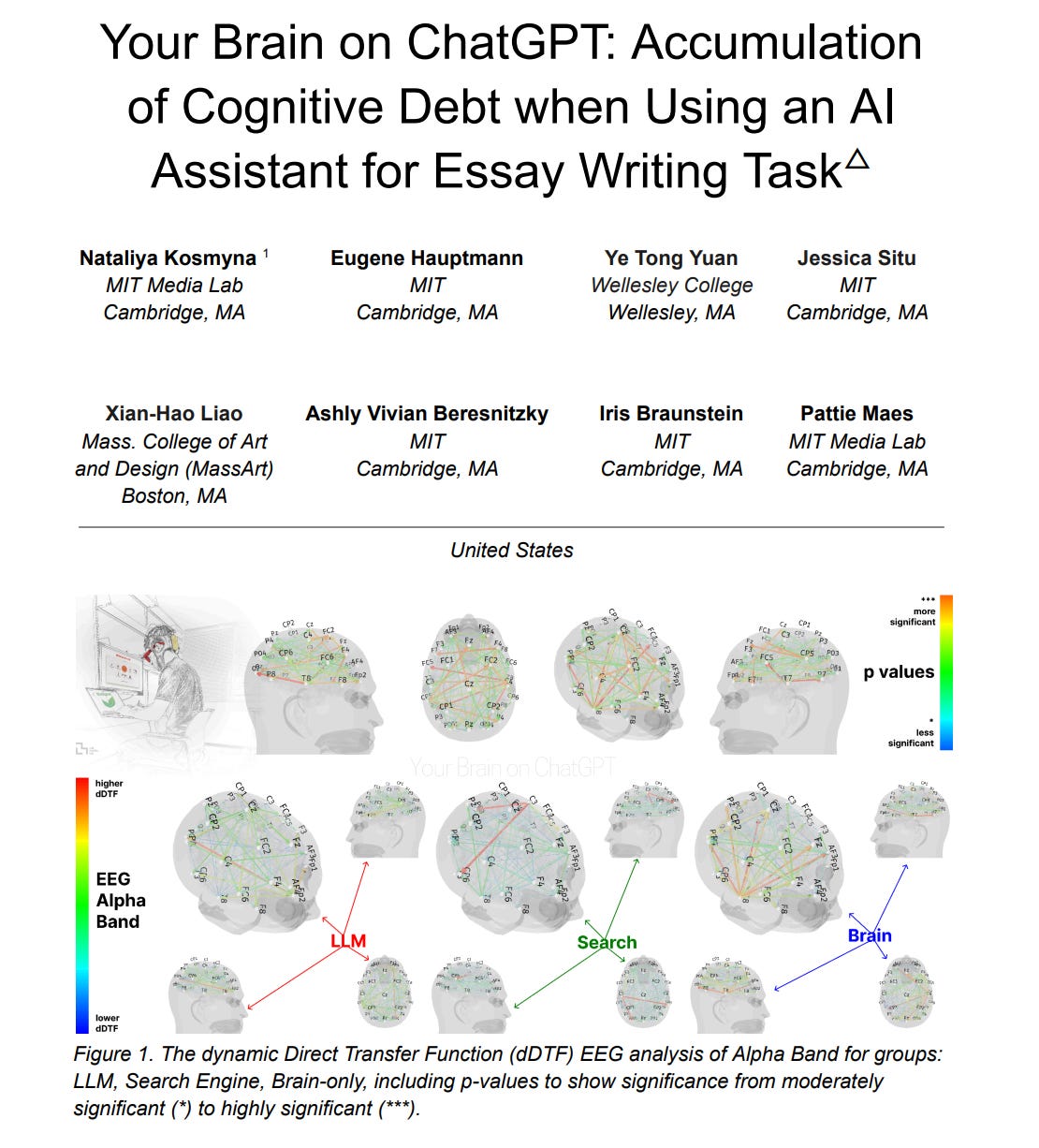

Questa settimana tutti hanno parlato dello studio “Your Brain on ChatGPT: Accumulation of Cognitive Debt when Using an AI Assistant for Essay Writing Task” curato da un team di ricerca del MIT di Boston. Il paper - che ancora non ha superato la fase di peer review - ha indagato gli effetti neuro-cognitivi dell’uso di ChatGPT e di un motore di ricerca durante la scrittura di saggi accademici.

Lo studio ha coinvolto 54 ricercatori divisi in tre categorie diverse, ognuna delle quali doveva scrivere un saggio nel tempo limite di 20 minuti, ma seguendo modalità completamente differenti.

Il primo gruppo, chiamato "LLM", poteva utilizzare solamente GPT-4, ma non aveva il permesso di accedere ad altri strumenti di ricerca su internet. Il secondo gruppo, denominato "Search Engine", aveva la libertà di cercare informazioni online attraverso motori di ricerca come Google, però gli era vietato categoricamente l'uso di qualsiasi modello linguistico IA. Il terzo gruppo, "Brain-only", doveva basarsi esclusivamente sulle proprie competenze e conoscenze personali, senza poter ricorrere ad alcun tipo di assistenza tecnologica esterna.

I risultati non sono rassicuranti: chi ha scritto con l’assistenza di un LLM mostra un’attività cerebrale significativamente ridotta rispetto a chi scrive “con il solo cervello”. I ricercatori hanno riscontrato che i partecipanti aiutati dall’IA avevano le connessioni neurali più deboli e meno distribuite, segno di minore sforzo cognitivo. Al contrario, chi scriveva senza aiuti manifestava i pattern di attivazione cerebrale più intensi e ampi.

Ma c’è di più! Nel momento in cui hanno chiesto a chi era abituato a usare l’IA di scrivere senza aiuto (dunque passando alla modalità tradizionale), hanno notato che il loro cervello faticava a riaccendersi, come un muscolo un po’ intorpidito dalla troppa assistenza. Un altro dato interessante è sul prodotto: i testi generati con IA tendevano ad avere somiglianze (omogeneità di stile, utilizzo di espressioni ricorrenti), risultando più standardizzati e impersonali. E infatti i partecipanti che usavano l’IA riportavano il livello più basso di senso di autorialità dei loro testi. Non sentivano l’elaborato veramente loro, e spesso non ricordavano bene cosa c’era dentro, tanto che faticavano a citare accuratamente parti del proprio elaborato! Al contrario, nel gruppo “brain-only” (tutto cervello niente IA) il senso di autorialità era alto e la memoria delle proprie argomentazioni molto più chiara.

Gli autori della ricerca parlano quindi di “debito cognitivo” dovuto all’IA: un impegno mentale minore che, a lungo andare, potrebbe ridurre apprendimento, senso di padronanza e pensiero critico. Non significa che l’IA ci rende più stupidi o che danneggia il cervello (come pure qualcuno ha scritto parlando di questo studio). Più semplicemente, i dati dimostrerebbero che l’uso dell’IA peggiorerebbe la nostra capacità di usare il cervello che abbiamo in dotazione e - se saranno confermati - dovrebbero suggerire prudenza nell’adottare indiscriminatamente questi strumenti in ambito didattico.

Un recente sondaggio Gallup rileva che, negli USA, l’utilizzo di strumenti di IA sul posto di lavoro è quasi raddoppiato in un anno. Oggi quasi 1 lavoratore americano su 5 dichiara di impiegare l’IA alcune volte a settimana, e l’8% addirittura tutti i giorni. La “spinta” viene soprattutto dai lavoratori della conoscenza, coloro che svolgono mansioni da ufficio.

Nel sondaggio di Gallup anche la conferma di quello che scriviamo da tempo: l’uso reale dell’IA da parte dei dipendenti sta superando la preparazione e le politiche aziendali in materia. Molti lavoratori stanno adottando strumenti come ChatGPT spontaneamente, senza indicazioni chiare dai vertici aziendali. Infatti, 7 aziende su 10 non hanno ancora alcuna linea guida o policy interna su come utilizzare l’IA in ufficio. Questo può generare problemi di sicurezza (dati riservati copiati e incollati in chatbot esterni), di qualità (ognuno usa l’IA a modo suo, senza standard condivisi) e perfino di etica (rischio di violare policy su copyright o divieto di discriminazioni). Appena il 6% dei dipendenti si sente “molto a suo agio” nell’usare l’IA. Curiosamente, questa percentuale è scesa rispetto al 2023: segno forse che col crescere dell’attenzione sull’IA, chi non è stato formato inizia a capire di essere rimasto indietro e quindi percepisce maggiore disagio.

Un ultimo dato fa riflettere: nonostante le roboanti previsioni di tagli al personale, i lavoratori non sembrano terrorizzati di essere rimpiazzati dalle macchine, almeno non nel breve termine. Solo il 15% teme che robot, automazione o IA possano minacciare il proprio posto nei prossimi 5 anni, una cifra invariata rispetto al 2023. La maggioranza vede ancora l’IA come un compagno più che un sostituto, uno strumento da integrare nel proprio lavoro. Evidentemente non hanno ascoltato le parole di Hinton.

Dani Grant - una CEO californiana - entra in una call ma si rende conto che, ad attenderla, ci sono solo gli assistenti IA degli altri partecipanti (probabilmente in ritardo), nessun umano. Le viene da ridere e posta lo screenshot su X (lo potete vedere qui sotto). È un segno dei tempi: tra poco ciascuno di noi potrebbe avere il suo assistente IA e delegargli non solo di prendere appunti ma addirittura di sostituirlo nelle call (quelle a cui non è riuscito o non ha voluto partecipare). Questo non significa solo che dovremmo abituarci a riunioni in cui oltre a esseri umani ci sono anche dei bot, ma anche che dobbiamo affrontare le implicazioni giuridiche di questo passaggio: esistono delle policy aziendali? Ognuno è libero di scegliere i propri strumenti con il rischio che vengano usate soluzioni economiche ma poco sicure? Come viene garantito il rispetto della riservatezza delle informazioni aziendali e dei dati personali (ai sensi del GDPR)? I nostri dati restano in UE o finiscono chissà dove? Ma soprattutto: come assicurarsi che gli altri partecipanti sappiano per tempo che in call ci saranno anche delle IA? E come possiamo garantire il loro diritto ad opporsi?

😂 IA Meme

Tutti pensiamo che il nostro lavoro sia difficile da automatizzare, finché un giorno…

😂 Meme IA che non lo erano - 1

Se frequentate i social, molto probabilmente vi sarete imbattuti nel video in cui - durante la cerimonia di laurea a UCLA (Los Angeles) - uno studente esulta con il laptop aperto e una schermata di ChatGPT. L’inquadratura è finita sul maxischermo e nella diretta streaming di ateneo e quindi, come si dice, è diventata virale.

Il laureato Andre Mai è stato costretto a scrivere un post su Linkedin - con l’aiuto di ChatGPT - in cui ha rivendicato di aver usato l’IA per scrivere la propria tesi nel pieno rispetto delle regole dell’Università. Il giovane rivendica che l’IA sia un “partner” che lo aiuta a riflettere, non una scorciatoia. Il post si chiude con un ringraziamento all’Università, ma anche a OpenAI e ChatGPT per tutto il sostegno.

Ovviamente il dibattito è tutt’altro che chiuso: che professionisti diventeranno gli studenti che usano l’IA per fare tutto? Migliori o peggiori rispetto ai loro predecessori?

😂 Meme IA che non lo erano - 2

A quanti di voi è capitato di chiedere a un chatbot IA di generare un testo per poi copiarlo e incollarlo, lasciando anche la parte introduttiva (quella che contiene le istruzioni che il chatbot dà all’utente)? Non succede solo agli studenti delle medie un po’ distratti.

Qualche giorno fa è capitato allo staff social del Presidente della Regione Siciliana, Renato Schifani, che ha pubblicato un post sulla crisi idrica che si apriva con queste parole:

Ecco una proposta per il post su Facebook, in prima persona e con enfasi, adatta a un tono istituzionale ma coinvolgente.

Seguiva il post vero e proprio. Ma la frase iniziale rivelava l’aiutino artificiale. Il post è stato corretto pochi secondi dopo, ma non abbastanza velocemente da evitare che qualcuno facesse screenshot e la notizia venisse ripresa dagli organi di informazione e dagli utenti dei social.

Questo episodio dimostra che l’IA è sempre più utilizzata nella comunicazione istituzionale. Come mai, però, nessuno - errori a parte - lo segnala come vorrebbero le regole dell’AI Act e gli stessi termini d’uso di molti chatbot IA?

📚 Consiglio di lettura: Reid Hoffman e il nuovo mantra per i neolaureati “Move fast and make things”

Stampa, automobile, IA. Ogni tecnologia trasformativa può dare “superpoteri” a milioni di persone. Sprecarli sarebbe il vero fallimento. Inizia così un’interessante lettera aperta che Reid Hoffman - cofondatore di LinkedIn, oggi investitore seriale - scrive sul San Francisco Standard ai ragazzi che escono dai cancelli delle università proprio mentre l’IA minaccia di sfoltire (anche pesantemente) il numero di coloro che lavorerà in ufficio.

Il titolo è già un programma: Move fast and make things (muoviti in fretta e costruisci cose), un’esortazione a cavalcare il cambiamento invece di provare a schermarsene. Fin dalle prime righe, infatti, Hoffman riconosce che le previsioni non sono rosee: il New York Fed certifica che il mercato per i giovani laureati “si è deteriorato”, mentre Dario Amodei (Anthropic) ipotizza che la metà dei ruoli entry-level possa sparire in cinque anni . Ma, aggiunge l’autore, proprio perché il terreno trema è il momento ideale per essere “primi sulla tavola” dell’onda IA.

Secondo Hoffman, tentare di impedire che la propria carriera sia impattata dall’IA è una strategia perdente. Meglio puntare su un percorso dinamico che sfrutti l’IA per:

aumentare la produttività personale

sperimentare velocemente

imparare in pubblico, dando importanza alle relazioni

Alle classiche qualità “non replicabili” dall’IA (empatia, creatività, senso etico) Hoffman aggiunge l’intenzione: la capacità di fissare un obiettivo e di mobilitare le nuove tecnologie per raggiungerlo.

L’articolo di Hoffman offre una miscela di realismo economico (parte dai numeri della futura crisi occupazionale) e ottimismo tecnologico (“è più facile che mai creare la propria occasione”). Il tono però è pragmatico, lontano sia dal catastrofismo sia dal tecnoentusiasmo acritico: un piccolo manuale di sopravvivenza – e di ambizione – per chi entra ora nel mercato del lavoro, ma anche per chi è ancora lontano dalla pensione e deve decidere su cosa puntare.

📚 Consiglio di lettura: le “4 S” che aiutano a capire quando l’IA rimpiazza l’essere umano

Bruce Schneier (esperto di sicurezza di fama mondiale) e Nathan Sanders (docente universitario) hanno firmato su The Conversation un articolo dal titolo eloquente: Will AI take your job? (trad. “L’IA ti ruberà il lavoro?”). La tesi è chiara fin dall’incipit: se un algoritmo è più veloce (Speed), agisce su una scala più larga (Scale), copre un campo più vasto (Scope) o raggiunge una maggiore sofisticazione (Sophistication), allora la sostituzione o, quantomeno, l’affiancamento dell’essere umano diventa probabile.

Gli autori partono da un’osservazione rassicurante: non sempre l’IA è più accurata, corretta o affidabile dell’essere umano. Ma basta che eccella in una delle quattro dimensioni per renderla conveniente sul piano economico.

La velocità rappresenta il primo vantaggio. L'IA eccelle in compiti che gli umani sanno fare bene ma troppo lentamente, come il miglioramento delle immagini satellitari.

La scala è forse l'aspetto più interessante. Mentre un esperto di marketing può analizzare e targetizzare efficacemente una campagna pubblicitaria, l'IA può farlo simultaneamente per milioni di utenti, prodotti e contesti. È così che funziona l'industria pubblicitaria digitale moderna, con decisioni prese migliaia di volte al secondo.

Il raggio d'azione riguarda la versatilità. ChatGPT e sistemi simili potrebbero non eccellere in nessun compito specifico meglio di uno specialista umano, ma possono gestire una gamma enormemente più ampia di attività con un livello di competenza accettabile. Questo è particolarmente prezioso per le organizzazioni che faticano a trovare persone con competenze multidisciplinari.

La sofisticazione si manifesta nella capacità dell'IA di considerare simultaneamente fattori complessi e interconnessi (come AlphaFold2 per l’analisi della struttura delle proteine). Questi sistemi non seguono regole convenzionali ma processano miliardi di interazioni in modi che sfuggono alla comprensione umana, ottenendo risultati superiori.

Un aspetto particolarmente interessante dell'analisi è come l'adozione dell'IA spesso cambi la natura stessa del compito. Il trading ad alta frequenza non è semplicemente fare trading più velocemente, ma è un tipo completamente diverso di attività finanziaria con nuove strategie e rischi. Allo stesso modo, i chatbot IA su larga scala hanno trasformato la natura della propaganda e della disinformazione.

In conclusione, gli autori propongono un criterio pragmatico: l'IA ha senso - e forse ci ruberà il lavoro - quando speed, scale, scope o sophistication rappresentano veri colli di bottiglia per raggiungere un obiettivo. Al contrario, quando questi fattori non sono limitanti, l'IA spesso delude, come nei suggerimenti automatici per messaggi di testo o nei chatbot del servizio clienti (che spesso creano più ostacoli che soluzioni).

💬 Il dibattito sull’IA

Se mi chiedete adesso qual è l’argomento di cui si parla ancora troppo poco, ma che sta arrivando più in fretta di quanto immaginiate, è la rivoluzione dell’intelligenza artificiale. Non è fantascienza né una moda sopravvalutata: è già qui. Poco fa, dietro le quinte, parlavo con alcune persone che lavorano nelle aziende di Hartford e vi garantisco che presto vedrete cambiare notevolmente il lavoro d’ufficio grazie a ciò che questi nuovi modelli di IA sono in grado di fare.

Non sono le parole di un techguru o di un CEO della Silicon Valley, ma dell’ex Presidente USA Barak Obama, pronunciate qualche giorno fa nel corso del Connecticut Forum.

Le parole di Obama suonano come un lucido ammonimento: l’IA non è (solo) un tema tecnologico, ma - mai come ora - sociale e politico. Parlamenti e governi dovrebbero occuparsene non solo in termini di investimenti e competitività economica. Servono politiche sull’alfabetizzazione e formazione (di giovani e meno giovani), politiche di tutela del lavoro e redistribuzione della ricchezza (lui dice che va “riorganizzata” la società) e devono essere scritte regole sull’ecosistema informativo (per garantire che le democrazie e la coesione sociale possano reggere).

È un lavoro difficile e da fare velocemente. Quali saranno i leader che accetteranno questa sfida?

🏛️ I corsi di LeggeZero: ‘RTD Academy 2025: come governare l’IA nella pubblica amministrazione’

🙏 Grazie per averci letto!

Per ora è tutto, torniamo la prossima settimana. Se la newsletter ti è piaciuta, sostienici: metti like, commenta o fai girare!

... proprio come diceva mio nonno quando mi sono iscritto ad Ingegneria. La storia si ripete‼️