🤖 AI Index 2024: lo stato dell'arte dell'IA (e delle sue regole) – Legge Zero #23

L'Human centered AI Institute di Stanford ha pubblicato la settima edizione del report più importante sull'impatto dell'IA nella società. Spoiler: non è vero che, per le regole, siamo all'anno zero.

🧠 L’era della regolazione dell’IA

Te Ani Solomon è una donna di etnia maori che vive a Rotorua, in Nuova Zelanda. Un mese fa, nel giorno del suo quarantasettesimo compleanno era con suo figlio adolescente quando è entrata in un supermercato per comprare qualcosa per cena. Mentre era al banco della carne, due uomini della sicurezza si sono avvicinati a lei e le hanno intimato di uscire dal negozio in quanto il sistema di riconoscimento facciale in uso (in via sperimentale!) l’ha - erroneamente - riconosciuta come “ladra” a cui non era consentito l’accesso.

A nulla sono valse le lamentele della donna che non solo non ha potuto comprare le costolette per la sua cena di festeggiamento, ma è stata umiliata davanti al figlio senza avere la possibilità di dimostrare che si trattava di uno sbaglio.

Eppure era tutto prevedibile (certi sistemi funzionano bene per maschi di etnia caucasica, male negli altri casi) ed evitabile. Un portavoce della catena di supermercati ha dato la colpa a un “errore umano”, dal momento che gli addetti alla sicurezza non hanno controllato, ma si sono fidati ciecamente del nuovissimo sistema IA. Ovviamente, il locale Garante Privacy - che già aveva aperto un’istruttoria per capire se questi sistemi riducono davvero i furti oppure, oltre a sbagliare spesso, non hanno alcuna utilità pratica - verificherà se sono state violate le leggi in materia di protezione dei dati personali.

Quanto accaduto in Nuova Zelanda dimostra, se ce ne fosse bisogno, che l’intelligenza artificiale è già nelle nostre vite, che il suo utilizzo ha enormi potenzialità ma presenta rischi per i diritti e le libertà delle persone, che per contrastare tali rischi c’è bisogno di norme, che molte norme in materia di IA ci sono già.

Una fotografia completa e complessa dello stato dell’arte globale dell’IA è contenuta nel recente AI Index 2024 pubblicato nei giorni scorsi dall’Human-Centred AI Institute dell’Università di Stanford (HAI). Si tratta della settima edizione del documento, molto attesa dopo il boom dell’IA generativa del 2023, e molto corposa (ben 502 pagine). Una lettura imperdibile per gli addetti ai lavori, ma utilissima per chiunque voglia capirne di più.

I risultati della ricerca sono articolati in nove capitoli (ricchissimi di numeri e grafici): ricerca e sviluppo, prestazioni tecniche, IA responsabile, economia, scienza e medicina, istruzione, politica e governance, diversità, opinione pubblica.

Le dieci principali conclusioni dell’AI Index 2024

Per chi non ha tempo di leggere tutto il documento, ecco i 10 punti chiave del report:

1. L'IA supera già gli umani in alcuni compiti, ma non in tutti

L'IA ha superato le prestazioni umane in diversi ambiti, inclusi la classificazione delle immagini e la comprensione dell'inglese. Tuttavia, rimane indietro in compiti più complessi come la matematica e la pianificazione.

2.Continua il primato dell'industria nella ricerca sull’IA

Nel 2023, il settore privato ha prodotto 51 LLM rilevanti, mentre il mondo accademico ne ha realizzati appena 15.

3.I sistemi di IA diventano sempre più costosi

I costi di addestramento dei principali modelli IA hanno raggiunto livelli senza precedenti ( 78 milioni di dollari per l’addestramento GPT-4 di Openai e 191 per Gemini di Google).

4. Gli Stati Uniti guidano il settore dell’IA e sono davanti Cina, UE e Regno Unito

Nel 2023, 61 modelli IA sono stati realizzati negli USA, superando di gran lunga l'Unione Europea con 21 e la Cina con 15.

5. Mancano standard sulla sicurezza dell’IA

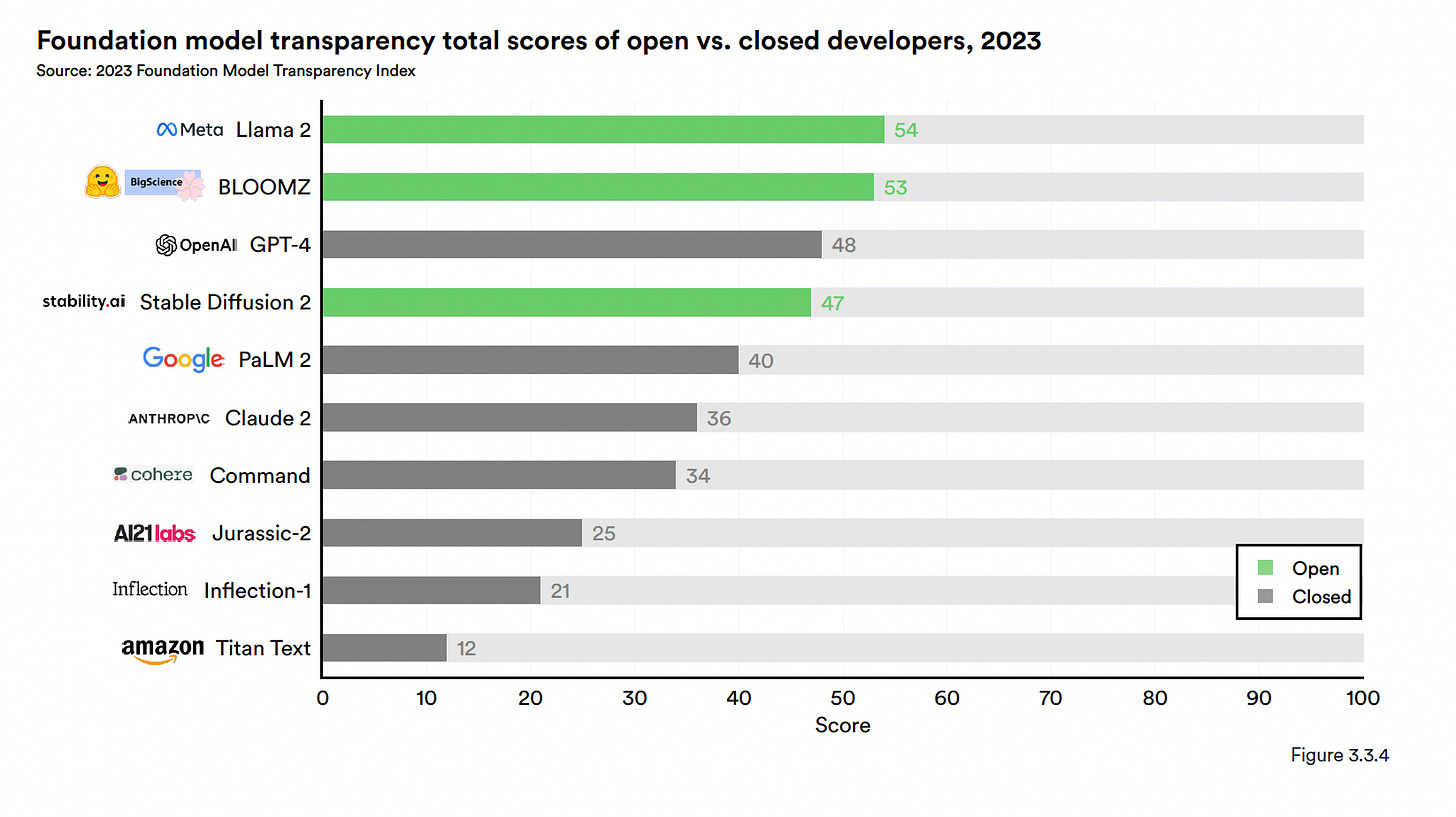

I principali sviluppatori, tra cui OpenAI, Google e Anthropic, testano i loro modelli usando differenti standard per sicurezza e responsabilità. Questa prassi complica gli sforzi per confrontare i rischi e i limiti dei principali modelli AI.

6. Gli investimenti in IA generativa sono aumentati vertiginosamente

Nonostante un calo degli investimenti complessivi, quelli nel settore dell’IA generativa sono aumentati di quasi otto volte rispetto al 2022, raggiungendo i 25,2 miliardi di dollari.

7. L’IA rende i lavoratori più produttivi e porta a un lavoro di qualità superiore

È ormai consolidato che che l’IA consente ai lavoratori di completare i compiti più rapidamente e di migliorare la qualità del loro lavoro.

8. Il progresso scientifico accelera ulteriormente grazie all’IA.

Nel 2022, l’IA ha iniziato a contribuire in modo rilevante alla scoperta scientifica. Il 2023, tuttavia, ha visto applicazioni ancora più significative in questo campo.

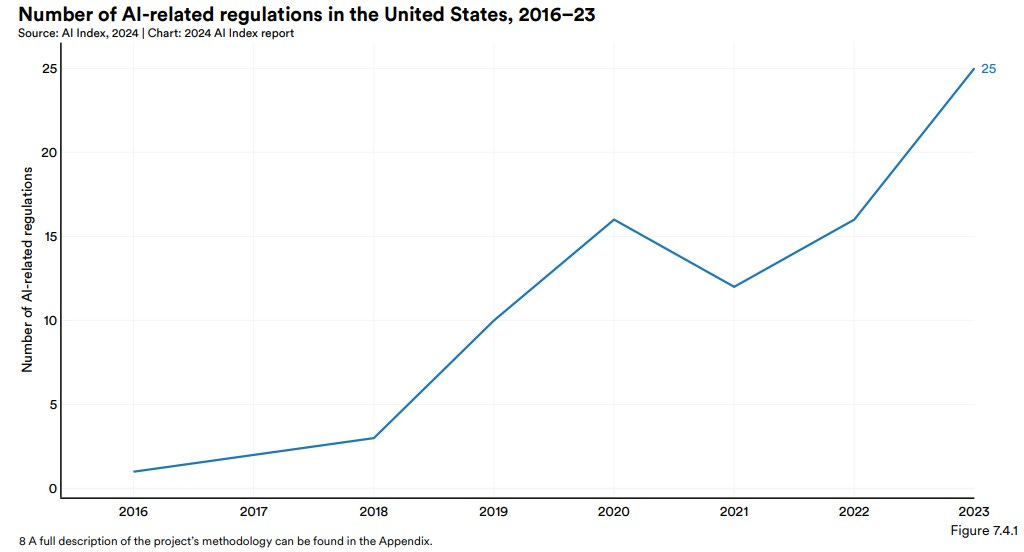

9. Il numero di regole sull’IA aumenta bruscamente

Le norme sull’IA sono ormai un fenomeno mondiale. Solo negli USA, nell’ultimo anno, il numero totale di norme sull’IA è cresciuto del 56,3%.

10. Le persone sono più consapevoli dell’impatto potenziale dell’IA (e più preoccupate).

Un sondaggio citato nel report mostra che, nell’ultimo anno, la percentuale di coloro che pensano che l’IA influenzerà drasticamente le loro vite nei prossimi anni è salita al 60%.

Lo stato dell’arte delle regole sull’IA

Se vi interessano le regole e la governance dell’IA, consigliamo di approfondire il Capitolo 7 del rapporto 2024 che contiene un focus sulle iniziative normative di USA e UE.

Come gli addetti ai lavori sanno bene, nel corso degli ultimi anni si sono moltiplicate norme che si occupano - in modo più o meno strutturato - di IA. Contrariamente a quanto pensano (e dicono) in tanti, anche negli USA.

In poche pagine, questo capitolo dell’AI Index smentisce molti luoghi comuni (ripetuti sui social e nei convegni) legati alla regolamentazione dell’IA e stimola riflessioni che approfondiremo in futuro:

alcune regole ci sono già e molte altre stanno arrivando, c’è il rischio di un caos normativo;

l’importante non è correre per arrivare primi, ma scrivere regole utili che siano in grado di conciliare lo sviluppo tecnologico con le libertà delle persone;

sarà importantissimo, nei prossimi mesi, lavorare a standard di regolazione globali (l’AI Act va in questo senso);

una delle sfide più importanti sarà quella dell’attuazione delle norme (specialmente da parte dei più grandi provider).

🔊 Un vocale da… Pegah Moshir Pour (attivista per i diritti umani e scrittrice): anche i regimi usano l’intelligenza artificiale, in particolare come strumento per conservare il controllo autoritario e reprimere il dissenso. Ce lo racconta un’attivista, facendoci comprendere che le democrazie si riconoscono proprio dalle leggi e dai diritti.

📰 In Ucraina 🇺🇦 il Ministero degli Esteri “assume” una portavoce generata dall’IA

Il Ministero degli Esteri ucraino ha una nuova portavoce, si chiama Victoria Shi ed è un avatar generato dall'intelligenza artificiale con l’aspetto e la voce di Rosalie Nombre (una celebrità ucraina).

L’iniziativa è solo uno dei progetti con cui il governo di Kiev sta utilizzando l’IA per migliorare la comunicazione nel difficile contesto di un conflitto. Si tratta di un progetto che potrebbe essere guardato con interesse da altri governi e amministrazioni, in tutto il mondo, ma che apre importanti interrogativi sulla fiducia del pubblico nelle dichiarazioni ufficiali, soprattutto quando queste provengono da una fonte non umana (qui un interessante articolo di Forbes). La trasparenza sull'uso di tali tecnologie sarà sufficiente per mantenere la fiducia del pubblico e garantire che la comunicazione istituzionale resti credibile?

📰 I CEO di OpenAI, Microsoft, Nvidia e Google nel board del governo USA 🇺🇸 per la sicurezza dell'IA

Sam Altman di OpenAI, Satya Nadella di Microsoft, Jensen Huang di Nvidia e Sundar Pichai di Alphabet (Google) sono tra i membri dell’AI Safety board, il nuovo Consiglio per la sicurezza dell'intelligenza artificiale del governo federale degli Stati Uniti. Questo consiglio, istituito dal Dipartimento della Sicurezza Interna, si riunirà su base trimestrale con il compito di supervisionare l'uso sicuro dell'IA nelle infrastrutture critiche (rete elettrica, trasporti, ecc.).

La scelta dell’amministrazione USA è forte: rafforza i legami con i principali operatori del settore dell’IA (su cui - al tempo stesso - deve vigilare), riconoscendo che anche il più solido dei governi ha bisogno del mercato per capire e affrontare i rischi dell’IA. Modello interessante, ma non replicabile: difficile pensare che i CEO di OpenAI, Microsoft e Google possano diventare consulenti di altri governi.

⚖️ Il Ministero dell’Economia 🇮🇹 ha escluso gli atti automatizzati dal contraddittorio preventivo in ambito fiscale

Con un decreto del 24 aprile il Ministero dell’Economia e delle Finanze ha individuato gli atti esclusi dall’obbligo di contraddittorio preventivo in ambito fiscale previsto dal nuovo Statuto del contribuente.

Il diritto al contraddittorio informato ed effettivo è di applicazione generale a tutta la materia tributaria, eccezion fatta per una serie di atti tra cui quelli che nel decreto vengono definiti “atti automatizzati e sostanzialmente automatizzati”. Il decreto in questione considera “automatizzato e sostanzialmente automatizzato” ogni atto emesso dall’Agenzia delle entrate riguardante esclusivamente violazioni rilevate dall’incrocio di elementi contenuti in banche dati nella disponibilità della stessa amministrazione. Insomma - stando alla lettura del testo - in caso di atti automatizzati, il contribuente non potrà rivolgersi all’Agenzia delle entrate per chiedere spiegazioni, ma potrà solo impugnarli davanti alle Corte di giustizia tributaria.

Sarebbe interessante sapere se - prima di scrivere questa norma - sia stata già effettuata una valutazione del rischio ai sensi dell’AI Act in modo da assicurare che gli accertamenti fiscali siano legittimi sulla base di questa norma e non espongano l’amministrazione a prevedibili contestazioni e contenziosi anche sotto questo profilo.

⚖️ Per il Garante privacy olandese 🇳🇱 il web scraping è “quasi sempre” illegale

L'Autorità per la Protezione dei Dati dei Paesi Bassi (AP) ha recentemente pubblicato delle linee guida per i soggetti privati sul web scraping (la raccolta e l’archiviazione automatica dei dati e informazioni pubblicati sul web). La sintesi delle linee guida sta nel - tanto breve quanto efficace - titolo della notizia con cui l’Autorità ha pubblicato il documento sul proprio sito.

Si tratta di un documento di grande interesse anche per l’addestramento di sistemi di intelligenza artificiale (tra l’altro, come qualcuno ricorderà, in Legge Zero #18 abbiamo scritto che AP sarà anche l’Autorità competente per l’intelligenza artificiale).

Il documento indica chiaramente che chi effettua attività di scraping per l'addestramento di IA deve considerare non solo la legittimità della raccolta dei dati in base al GDPR, ma anche le implicazioni etiche e le potenziali conseguenze sui diritti fondamentali degli individui coinvolti.

⚖️ Il Governo USA 🇺🇸 pubblica una guida all’uso dell’IA generativa per i dipendenti pubblici

L’US Office of Personnel Management ha pubblicato una guida destinata ai dipendenti federali sull’uso di sistemi di IA generativa per scopi lavorativi.

La guida è un documento sintetico, di agevole lettura, che parte illustrando benefici e rischi dell’uso di sistemi IA nell’attività degli uffici pubblici per poi indirizzare importanti raccomandazioni (es. controllare i risultati dell’IA prima della loro pubblicazione o diffusione). Interessante anche la definizione dei tre principali casi d’uso per l’impiego di IA generativa nel settore pubblico: analizzare o riassumere informazioni, creare materiali per la comunicazione, sviluppare codice o software.

Si tratta di un documento utile non solo per i dipendenti delle amministrazioni USA e un punto di riferimento per chi, anche dalle nostre parti, prima o poi dovrà scrivere regole analoghe. Non serve sempre reinventare la ruota.

😂 IA Meme

Non tutti credono che sia una buona idea nominare i CEO dei più grandi provider in un board che deve occuparsi di sicurezza dell’IA.

📚 Consigli di ascolto: "Radio Davos" i podcast su IA del World Economic Forum

Tutti parlano e scrivono di IA. Siamo ormai sommersi da una quantità di notizie e riflessioni - spesso banali - a cui è difficile stare dietro. Ed è difficile selezionare i contenuti di valore (come l’AI Index di cui abbiamo parlato sopra). Consapevoli di ciò, questa settimana, vi consigliamo la selezione di podcast su IA curata dal World Economic Forum.

In questa pagina web hanno messo in fila tutti gli episodi dei loro podcast utili a capire lo stato dell’arte dell’IA e le sfide che pone. Ogni episodio è una finestra su quello che pensano esperti di fama globale, leader e protagonisti di questa rivoluzione (come Yann LeCun di Meta, Anna Makanju di OpenAI, Zanny Minton Beddoes di The Economist, Ian Bremmer di Eurasia Group, Stuart Russell della University of California).

Buon ascolto!

📣 Eventi

Think / Festival della cultura digitale - Figline Valdarno, 10-12.05.2024

Constitutional Democracy in the Age of Artificial Intelligence - Webinar, 14.05.2024

Procedamus 2024 - Salerno, 23.05.2024

Per ora è tutto, torniamo la prossima settimana. Se la newsletter ti è piaciuta, commenta o fai girare. Grazie!